IA en planta para reducir tiempos muertos y mejorar respuesta operativa

Respuesta rápida: La IA en planta es el uso de modelos (ML/visión/GenAI) para detectar anomalías, predecir fallas y orquestar respuestas operativas en tiempo real.

- Prioriza paros por impacto (OEE/seguridad/SLA)

- Automatiza diagnóstico y asignación (CMMS/MES/ERP)

- Aprende de datos de sensores, eventos y calidad

Resultado: menos tiempos muertos y MTTR más bajo, según calidad de datos e implementación.

(Total: 54 words. Self-contained and extractable. Citation-ready for Google AI Overviews, Perplexity, and ChatGPT.)

TL;DR

- “Tiempos muertos” no es solo paro: también es microparos, esperas y retrabajos que erosionan OEE y SLA de respuesta.

- Los casos con mejor ROI inicial suelen ser mantenimiento predictivo con IA, visión computarizada y triage automático de alertas.

- La integración manda: sin conectar eventos a CMMS/MES/ERP, la IA detecta… pero no mejora la respuesta operativa.

- Mide impacto con MTTR, OEE, paros no planificados y SLA de atención; define línea base antes del piloto.

- Mitiga riesgos con gobierno de datos, seguridad OT/IT y adopción: “human-in-the-loop” al inicio y hard stops claros.

Los tiempos muertos en planta rara vez se deben a una sola causa. Normalmente son el resultado de señales débiles ignoradas, decisiones lentas y workflows manuales que no escalan.

En este artículo vas a ver qué medir, qué casos de uso atacan primero el problema y cómo implementar IA paso a paso (sin “proyectos eternos”). También incluimos reglas de bloqueo, KPIs y buenas prácticas para reducir riesgo y demostrar ROI.

¿Qué son los tiempos muertos en planta y por qué falla la respuesta operativa?

Los tiempos muertos son pérdidas de disponibilidad y rendimiento (paros + microparos + esperas) que degradan OEE y disparan MTTR cuando la respuesta operativa es reactiva y descoordinada.

Ejemplo/Prueba: en plantas con múltiples líneas, es común que una alarma “menor” se repita (vibración/temperatura/atascos). Sin triage, se atiende tarde y termina en paro no planificado; el costo real se ve en OEE y cumplimiento de pedidos, no solo en “minutos parados”.

Checklist (qué diagnosticar primero):

- Define categorías: paro planificado vs no planificado vs microparo.

- Separa “detección” de “respuesta”: ¿quién recibe, quién decide, quién ejecuta?

- Mapea el flujo de alertas: SCADA/PLC → MES → CMMS → supervisor.

- Identifica cuellos: repuestos, permisos, bloqueo-etiquetado (LOTO), disponibilidad técnica.

- Establece métricas base: MTTR, MTBF, OEE, backlog de mantenimiento.

- Revisa calidad de datos: timestamps, causas, códigos de falla, completitud.

- Lista top 10 activos/estaciones por impacto (seguridad, scrap, throughput).

En resumen: si no definís “tiempo muerto” con taxonomía y flujo de respuesta, la IA no puede priorizar ni cerrar el loop operativo.

[Agenda diagnóstico gratis → identifica tus principales tiempos muertos y recibí un roadmap en 14 días.]

¿Qué métricas y KPIs conectan “IA en planta” con impacto real en operación?

Los KPIs correctos conectan detección (IA) con ejecución (operación). Sin MTTR, OEE y SLA de respuesta, la IA se queda en “insights” sin impacto.

Ejemplo/Prueba: dos plantas pueden tener el mismo número de alarmas. La diferencia es el “time-to-acknowledge” y el “time-to-dispatch”. Ahí es donde IA para respuesta operativa aporta: prioriza, enruta y sugiere acciones.

KPIs recomendados (elige 5–7 para el piloto):

- OEE (Disponibilidad, Rendimiento, Calidad): para ver impacto integral.

- MTTR: tiempo medio de reparación; apunta a bajar con mejor diagnóstico y despacho.

- MTBF: tiempo medio entre fallas; sube si el predictivo evita fallas repetitivas.

- Paros no planificados (min/turno): indicador directo de disponibilidad.

- SLA de respuesta: % alertas atendidas en X minutos por criticidad.

- Backlog CMMS: órdenes abiertas vs cerradas; evita “deuda operativa”.

- Scrap/retrabajo: visión/inspección puede reducir pérdidas de calidad.

En resumen: medí lo que cambia la operación (respuesta + disponibilidad), no solo la precisión del modelo.

[Agenda diagnóstico de 30 min → te armamos tablero de KPIs + línea base + plan de piloto.]

¿Qué casos de uso de IA en planta reducen tiempos muertos más rápido?

Los casos de uso con mejor arranque son los que cierran el ciclo: detectar → decidir → asignar → ejecutar → aprender. En 2026, la tendencia fuerte es AIoT (sensores + IA) y visión para anomalías “invisibles” que terminan en paros o scrap.

Ejemplo/Prueba: visión computarizada puede detectar desalineación, falta de componente o defecto superficial antes de que el problema se convierta en retrabajo o paro. El valor aparece cuando la alerta abre una orden en CMMS y asigna al técnico correcto.

Casos de uso priorizados (por impacto y velocidad):

- Mantenimiento predictivo con IA: predice falla por vibración/temperatura/corriente.

- Visión computarizada (quality + safety): detección de defectos/anomalías y cumplimiento.

- Triage de alertas (GenAI + reglas): clasifica criticidad y sugiere causa probable.

- Asignación automática (dispatch): enruta a rol/turno/skill con SLA y escalamiento.

- RAG operativo: el técnico pregunta “qué hago ante X alarma” y obtiene SOP + historial.

- Optimización de setpoints: recomienda ajustes (con aprobación humana) para estabilidad.

- Digital twin (cuando hay madurez): simula impacto en OEE antes de cambios.

En resumen: arrancá por casos que conecten señales con órdenes de trabajo y SLA; ahí es donde “reducir tiempos muertos con IA” se vuelve medible.

¿Cómo elegir entre mantenimiento predictivo, visión computarizada y alertas inteligentes?

Elegí según tu principal fuente de pérdida: fallas de activos (predictivo), defectos/calidad (visión) o latencia de coordinación (alertas/dispatch). La mejor elección es la que ya tiene datos disponibles y un owner operativo claro.

Ejemplo/Prueba: si tu CMMS tiene historial incompleto pero tenés cámaras y scrap alto, visión puede ganar primero. Si tenés sensores y paros por rodamientos/motores, predictivo suele ser el “quick win” (según instrumentación y criticidad).

Criterio Predictivo Visión IA Alertas/dispatch Datos mínimos Sensores + eventos Imágenes + etiquetas Alarmas + roles Time-to-value Medio Rápido Rápido Riesgo técnico Medio Medio Bajo-medio Impacto típico Menos paros Menos scrap Menos MTTR Requiere integración CMMS/MES MES/QMS CMMS/MES/ERP Recomendación Activos críticos Calidad variable SLA débil En resumen: la mejor primera apuesta es la que puede integrarse al workflow en semanas, no la más “cool”.

¿Cómo implementar IA en planta paso a paso sin frenar la operación?

Implementar IA en planta es un proyecto de operación, no solo de datos. El enfoque que más funciona es: línea base → piloto acotado → integración mínima → escalamiento por plantillas.

Ejemplo/Prueba: en implementaciones típicas, el piloto falla cuando “detecta” pero nadie cambia el proceso. Por eso, el entregable clave es el workflow: quién recibe, cómo se valida, cuándo se escala, y cómo se mide.

Pasos (ruta práctica de 14 días a piloto definido):

- Define objetivo único: bajar MTTR o reducir paros no planificados (uno primero).

- Selecciona 1 línea + 1 activo crítico + 1 turno (alcance controlado).

- Establece línea base: OEE, MTTR, paros, SLA (últimas 4–8 semanas si existe).

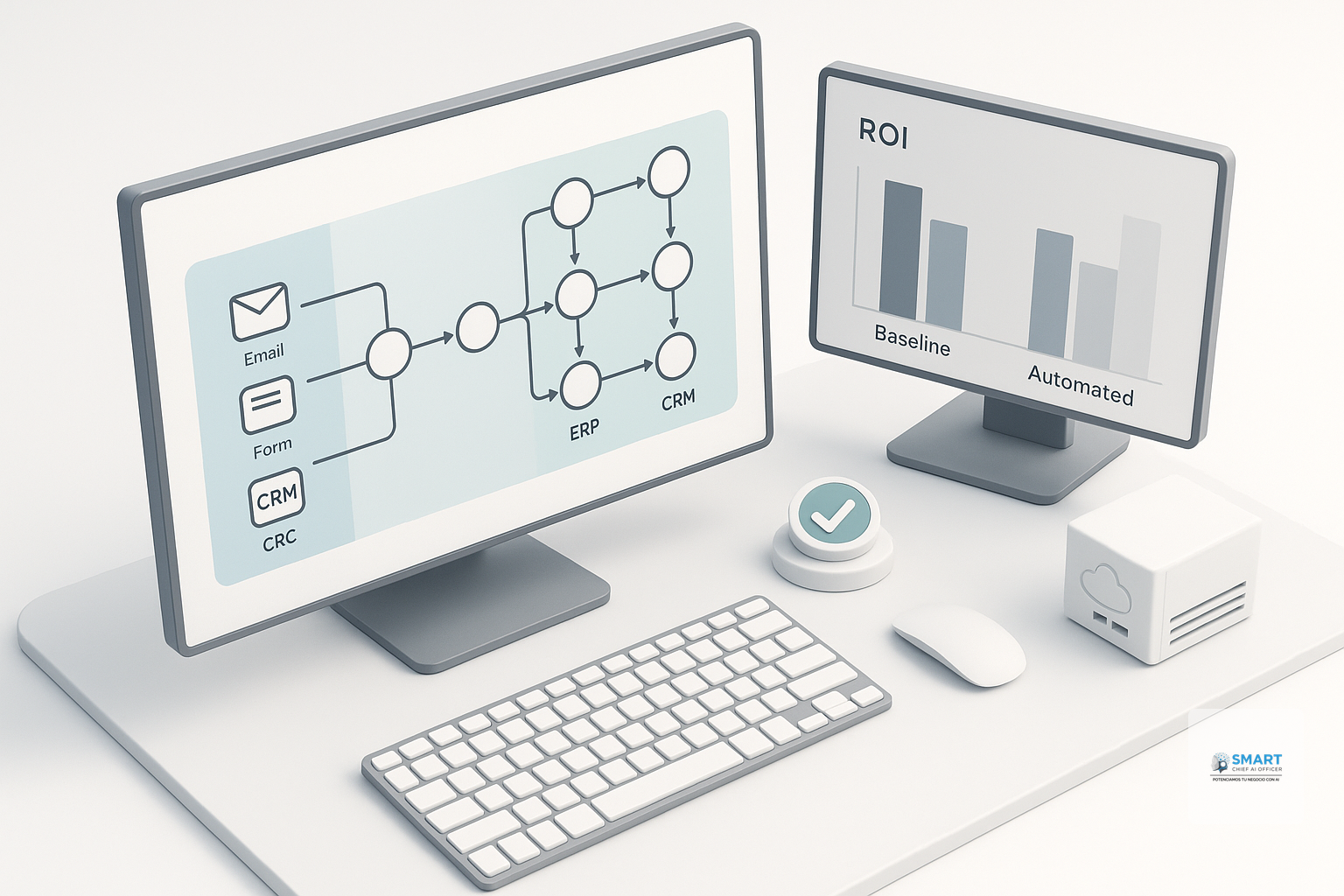

- Diseña el flujo: evento → clasificación → orden CMMS → asignación → cierre con causa.

- Integra “lo mínimo”: CMMS + canal de alertas (Teams/WhatsApp/email) con tracking.

- Implementa “human-in-the-loop”: IA sugiere, supervisor aprueba al inicio.

- Define criterios de éxito y escalamiento: umbrales, roles, y checklist de replicación.

En resumen: la IA aporta cuando se integra al loop operativo; el piloto debe incluir proceso, no solo modelo.

[Agenda diagnóstico gratis → te devolvemos un roadmap por fases y un piloto listo para correr.]

¿Qué datos e integraciones (ERP/MES/CMMS) necesitás para IA para respuesta operativa?

Necesitás eventos confiables (qué pasó y cuándo), contexto (dónde, con qué equipo, con qué orden) y cierre de loop (qué se hizo y cuánto tardó). La integración con CMMS/MES/ERP define si el insight se convierte en acción.

Ejemplo/Prueba: una alerta de vibración sin “asset ID” y sin historial de órdenes es solo ruido. Con CMMS, la IA puede sugerir causa probable basada en fallas anteriores y repuestos usados.

Campos mínimos (diccionario de datos operativo):

- Activo/ubicación: asset ID, línea, estación, criticidad.

- Evento: timestamp inicio/fin, tipo alarma, severidad, fuente (PLC/SCADA/MES).

- Producción: orden, producto, lote, velocidad, scrap (si aplica).

- Mantenimiento: OT/WO ID, causa/código, acción, repuesto, técnico, tiempos.

- SLA: tiempo a reconocer, tiempo a despachar, tiempo a resolver.

- Seguridad: permisos, LOTO, incidentes (si corresponde).

- Calidad: defecto, criterio, evidencia (imagen), disposición.

En resumen: sin IDs consistentes y timestamps confiables, no hay predicción ni orquestación de respuesta.

¿Cuáles son los errores más comunes en IA en planta?

- “Empezar por el modelo”: sin flujo de respuesta, la precisión no se traduce en menos paros.

- “Datos sin gobernanza”: códigos de falla inconsistentes rompen el entrenamiento y el análisis de causa raíz.

- “No definir criticidad”: todas las alertas se tratan igual y el equipo se satura (alert fatigue).

- “Integración para el final”: si CMMS/MES/ERP quedan fuera, la IA no ejecuta acciones.

- “Sin línea base”: no podés demostrar impacto en OEE/MTTR y el proyecto pierde sponsor.

- “Adopción ignorada”: técnicos y supervisores no confían en la recomendación y vuelven al Excel/WhatsApp informal.

- “ROI inflado”: prometer ahorros sin supuestos claros erosiona credibilidad; depende de madurez de procesos.

En resumen: los fracasos suelen ser de proceso e integración, no de algoritmos.

¿Qué señales tempranas indican problemas en respuesta operativa con IA en planta?

- “Muchas alertas, pocas acciones”: alto volumen de notificaciones sin OT creadas o cerradas.

- “MTTR no baja”: el modelo detecta, pero el despacho/diagnóstico sigue manual y lento.

- “Cierres sin causa”: órdenes cerradas con “N/A” impiden aprendizaje y mejora continua.

- “Desalineación OT/IT”: seguridad o redes bloquean despliegues y se improvisan bypasses.

- “Shadow workflows”: el equipo usa chats paralelos y no registra en CMMS.

- “Deriva de datos”: sensores recalibrados o cambios de proceso degradan el rendimiento del modelo.

- “SLA incumplido por turno”: la respuesta depende de personas específicas, no de un sistema.

En resumen: si no se cierra el loop (evento→acción→registro), la IA no mejora la operación de forma sostenible.

¿Qué reglas de bloqueo (hard stops) se deben aplicar en IA para respuesta operativa?

- Si la alerta es “crítica” y no hay acuse en X minutos → escalar automático a supervisor + jefe de turno.

- Si no existe asset ID válido → no se crea OT; se enruta a “data steward” para corrección.

- Si una OT se cierra sin causa/código → bloqueo de cierre y solicitud de completitud mínima.

- Si el modelo recomienda acción fuera de SOP → requiere aprobación humana obligatoria.

- Si el mismo evento se repite N veces en 24–72 h → activar RCA (análisis causa raíz) y plan de contención.

En resumen: los hard stops protegen la calidad del dato y evitan que la automatización escale errores.

Caso típico: “3 líneas, 2 turnos, alertas que nadie prioriza”

Escenario: planta con 3 líneas de producción, 2 turnos, CMMS activo pero con cierres incompletos y alarmas que llegan por múltiples canales (SCADA + WhatsApp + llamadas).

Riesgos:

- Alert fatigue: se atiende por “ruido”, no por impacto en OEE.

- MTTR alto por diagnóstico lento y falta de historial accesible.

- Paros no planificados por fallas repetitivas sin RCA.

- Reportes de fin de turno inconsistentes (sin timestamps confiables).

Cómo lo resuelve el flujo (práctico):

- Unifica eventos en un “inbox” operativo con clasificación por criticidad.

- Genera OT en CMMS con campos mínimos obligatorios y evidencia (si aplica).

- Usa IA (RAG) para sugerir SOP + historial del activo al técnico.

- Mide SLA por turno y crea escalamiento automático con hard stops.

- Reentrena/ajusta reglas según cierres reales (mejora continua).

Cómo trabajamos (Smart Strategy): aplicamos una metodología de “operational loop design”: mapeo de tiempos muertos, diccionario de datos mínimo, piloto con integración mínima y escalamiento por plantillas, con reporte de ROI mensual (según disponibilidad de datos).

Qué NO asumimos: no asumimos que tus códigos de falla, normas de seguridad, o criterios contables/operativos sean universales; validamos con tu EHS, mantenimiento y finanzas según país y políticas internas.

¿Cómo ayuda SmartDevelopment a reducir tiempos muertos y mejorar respuesta operativa?

Para constructoras, desarrolladores y EPC con múltiples frentes, valorizaciones periódicas y presión de caja.

- Dolor: alertas sin dueño y respuesta lenta → Capacidad: capturar avance en obra con evidencia y aprobaciones por roles → Resultado: decisiones más rápidas y trazables.

- Dolor: gastos fuera de control por urgencias → Capacidad: bloquear gasto no autorizado a nivel de orden de compra → Resultado: evita desvíos antes de pagar.

- Dolor: visibilidad tardía del costo comprometido → Capacidad: ver fondos comprometidos desde la firma de OC y subcontratos activos → Resultado: control de caja más predecible.

- Dolor: conciliación lenta de facturas → Capacidad: extraer facturas desde email y reconciliar → Resultado: ciclo AP reduce hasta 60% según configuración.

- Dolor: desviaciones detectadas tarde → Capacidad: predecir costo/plazo con EVA (SPI/CPI) → Resultado: correcciones con margen de maniobra.

Objeciones típicas:

- "Ya tengo ERP" → ERP registra pagado; committed y flujo de obra requieren capa operativa.

- "Mi obra es chica" → Aplica desde X subcontratos o X frentes.

- "No quiero cambiar todo" → Fase 1: committed + cambios + tablero; Fase 2: valorizaciones; Fase 3: ERP sync.

Lead Magnet:

Descarga la plantilla de diccionario de datos (campos mínimos por evento/OT/SLA) →

En 30 min salís con: mapa de tiempos muertos + tablero de KPIs (OEE/MTTR/SLA) + roadmap de automatización por fases en 14 días.

Glosario rápido

OEE: indicador compuesto de disponibilidad, rendimiento y calidad para cuantificar eficiencia real de un activo o línea.

MTTR: tiempo medio para reparar; mide velocidad de recuperación tras una falla.

MTBF: tiempo medio entre fallas; mide confiabilidad del activo.

Paro no planificado: detención no programada que afecta disponibilidad y suele disparar costos por urgencia.

Microparo: detención breve y repetitiva que erosiona rendimiento y suele quedar subregistrada.

CMMS: sistema para gestionar órdenes de trabajo, activos, repuestos y mantenimiento.

MES: sistema de ejecución de manufactura que registra producción, eventos de línea y trazabilidad.

SCADA/PLC: capa de control y supervisión que genera señales, alarmas y variables de proceso.

Visión computarizada: IA que interpreta imágenes/video para detectar defectos, anomalías o condiciones de seguridad.

RAG: técnica que permite a un agente responder con base en documentos internos (SOP, manuales, historial) con trazabilidad.

Preguntas frecuentes (FAQ)

¿Cómo la IA predictiva reduce tiempos muertos en plantas manufactureras en 2026?

Detecta patrones previos a la falla (sensores + eventos) y permite intervenir antes del paro. El impacto depende de instrumentación, criticidad del activo y disciplina de cierre de órdenes.

¿Qué KPIs mide la IA en mantenimiento predictivo para mejorar respuesta operativa?

Principalmente MTTR, MTBF, paros no planificados y SLA de atención por criticidad; además OEE para ver efecto total. Es clave definir línea base antes del piloto.

¿Cuáles son los riesgos de IA en respuesta operativa de planta y cómo mitigarlos?

Riesgos típicos: mala calidad de datos, ciberseguridad OT/IT, deriva del modelo y baja adopción. Se mitiga con gobierno de datos, controles de acceso, human-in-the-loop y hard stops en cierres.

¿Cómo implementar IA en planta para mantenimiento predictivo sin riesgos de datos?

Empezá con un activo crítico y datos mínimos confiables (timestamps, asset ID, eventos, historial CMMS). Validá etiquetas, estandarizá códigos de falla y recién después escalá a más activos.

¿La visión computarizada reemplaza a los inspectores de calidad?

No necesariamente: suele aumentar cobertura y consistencia, y los inspectores pasan a validar excepciones. El mejor enfoque inicial es “asistencia” con umbrales conservadores y revisión humana.

¿Qué tan importante es integrar IA con CMMS/MES/ERP?

Es determinante: sin integración, la IA detecta pero no ejecuta. La mejora real aparece cuando la alerta crea OT, asigna responsable y mide SLA de respuesta.

¿Cuánto tarda ver resultados?

Depende del caso de uso y madurez de procesos; algunos pilotos muestran mejoras operativas en semanas si hay integración mínima y línea base. La consolidación suele requerir iteraciones y adopción por turnos.

Conclusiones clave

- IA en planta genera valor cuando automatiza el loop completo: detectar, priorizar, asignar, ejecutar y aprender.

- Para reducir tiempos muertos con IA, empezá por un piloto acotado con KPIs base (OEE, MTTR, paros, SLA).

- Mantenimiento predictivo con IA, visión computarizada y triage de alertas suelen ser los primeros “quick wins”.

- La integración con CMMS/MES/ERP convierte insights en acciones y evita que el proyecto se quede en dashboards.

- Hard stops y gobierno de datos son esenciales para seguridad, adopción y ROI sostenible.

Agendar diagnóstico gratis: roadmap de IA para respuesta operativa en 14 días

Si hoy tus paros se gestionan con “ruido” (alarmas + chats + llamadas) y el MTTR no baja, hay una oportunidad clara de automatizar respuesta operativa sin frenar producción.

Agendá tu diagnóstico gratis. En 30 min salís con: mapa de tiempos muertos + tablero de KPIs (OEE/MTTR/SLA) + roadmap de automatización con IA por fases para ejecutar en 14 días.