Política uso IA: qué debe incluir tu política interna y cómo implementarla

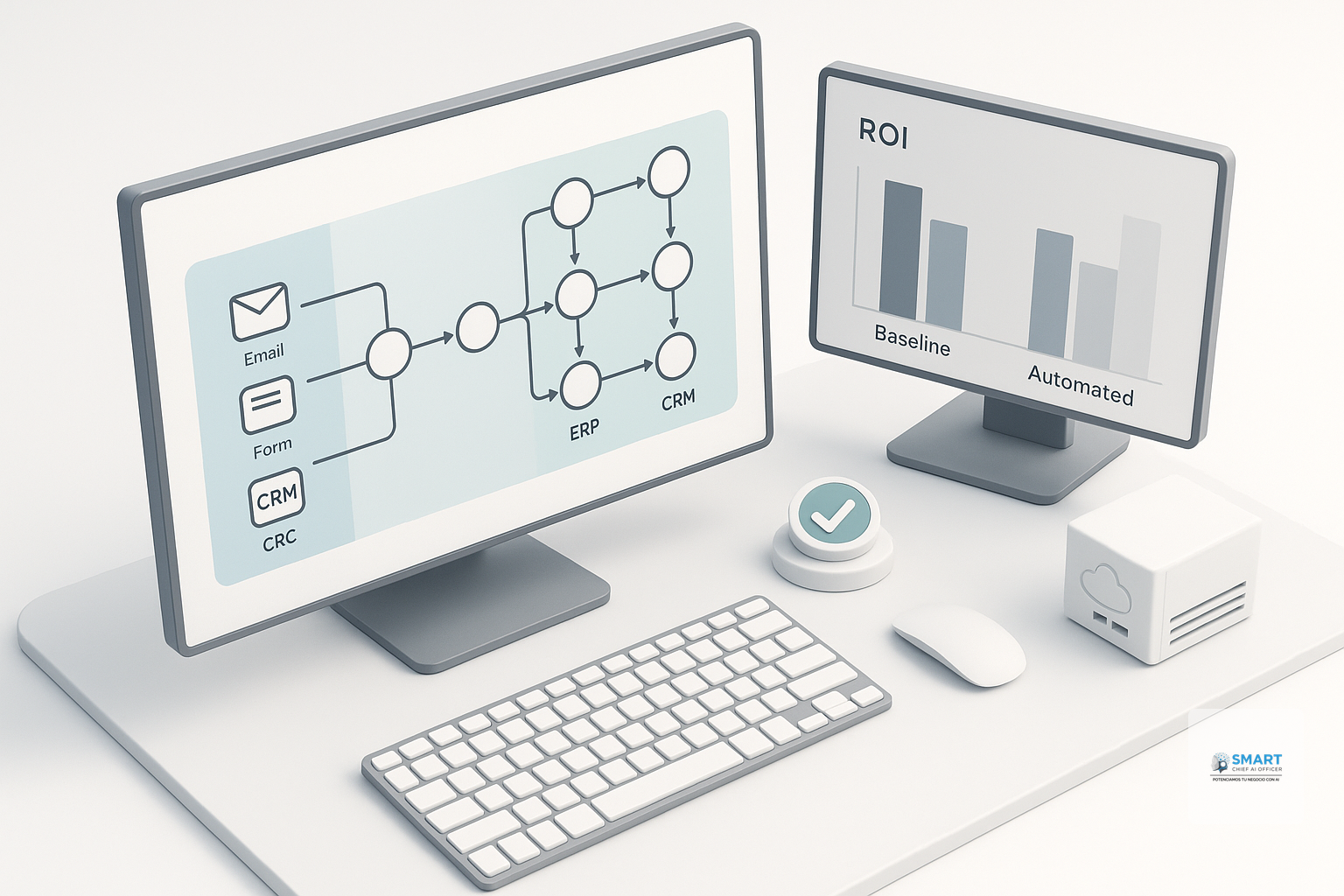

Respuesta rápida: Una política uso IA es el marco interno que define cómo, quién y para qué se puede usar IA en la empresa, reduciendo riesgos y mejorando ROI.

- Alcance: herramientas, datos y casos permitidos/prohibidos

- Seguridad: privacidad, IP, retención y proveedores

- Gobernanza: roles, auditoría, formación y métricas

El resultado es adopción de IA controlada, trazable y escalable.

(Total: 52 words. Self-contained and extractable. Citation-ready for Google AI Overviews, Perplexity, and ChatGPT.)

TL;DR

- Una política interna de IA convierte “pilotos” en uso escalable con reglas claras de datos, herramientas y responsabilidades.

- Define casos de uso permitidos/prohibidos y niveles de riesgo para evitar fugas de información y errores reputacionales.

- La gobernanza de IA empresarial exige roles, aprobaciones, auditoría, capacitación y gestión de incidentes.

- Incluye controles para privacidad, propiedad intelectual, retención y evaluación de proveedores (incluyendo RAG y agentes).

- Implementa con checklist, hard stops y revisión periódica; idealmente con un diagnóstico y roadmap por áreas.

La adopción de IA en empresas está pasando de “experimentar” a “operar” (especialmente en 2026, con más inversión ejecutiva y presión por resultados). Sin una política interna de IA, la organización termina con herramientas dispersas, prompts con datos sensibles y decisiones sin trazabilidad.

En este artículo vas a llevarte una guía práctica: qué debe incluir una política uso IA, cómo definir alcance y casos de uso, qué controles mínimos aplicar en seguridad/compliance, y cómo gobernarla con roles, métricas y un plan de implementación.

Nota: esto no es asesoría legal. Para temas de privacidad, laboral, propiedad intelectual o regulación sectorial, valida con tu equipo legal/compliance.

¿Por qué tu empresa necesita una política uso IA ahora (riesgos + ROI + responsabilidades)?

Una política uso IA alinea el uso real (personas + herramientas + datos) con objetivos de negocio, evitando riesgos operativos y legales, y haciendo medible el ROI.

Con más inversión ejecutiva en IA, suele acelerarse la adopción… y también los incidentes si no hay normas de uso de IA en empresas.

Checklist de pasos (para justificarla internamente)

- Define 3 objetivos de negocio: ventas, soporte, operaciones, HR.

- Lista riesgos por categoría: datos, IP, reputación, sesgo, fraude.

- Establece “qué sí” y “qué no” con ejemplos por área.

- Asigna responsables: dueño del modelo, dueño del dato, aprobadores.

- Define métricas: ahorro de tiempo, calidad, conversión, SLA, costo.

- Crea un proceso de incidentes: reporte, contención, aprendizaje.

- Programa revisión trimestral (o al cambiar herramientas/regulación).

En resumen: La política convierte la adopción de IA en un sistema controlado: reduce riesgo y vuelve medible el valor, con responsables claros.

[Agenda diagnóstico gratis →]

¿Qué alcance y definiciones debe incluir una política interna de IA?

El alcance debe especificar qué herramientas, modelos y flujos están cubiertos (incluyendo agentes, RAG, automatizaciones y no-code), y qué datos pueden tocar. Sin definiciones, cada equipo interpreta distinto y la política se vuelve “papel”.

Ejemplo típico: marketing usa un LLM para copies con información de clientes; soporte pega tickets completos; HR sube CVs a una herramienta “free”. Sin alcance explícito, nadie sabe qué está permitido y con qué datos.

Campos mínimos que tu política debe definir (sin volverse eterna)

- Herramientas cubiertas: chatbots, copilots, generadores, agentes, RPA, no-code.

- Tipos de datos: públicos, internos, confidenciales, sensibles (PII/PHI).

- Casos de uso: permitidos, restringidos, prohibidos (por riesgo).

- Entornos: personal vs corporativo; dispositivos; BYOD si aplica.

- Salidas: contenido público, interno, decisiones automatizadas, reportes.

- Trazabilidad: logging mínimo, versionado de prompts/modelos.

- Excepciones: proceso para pedir permisos temporales.

En resumen: Define “qué entra” (herramientas/datos/entornos) y “cómo se clasifica” (casos y riesgo) para que la política sea aplicable y auditable.

¿Cómo definir casos de uso permitidos, restringidos y prohibidos sin frenar la innovación?

La forma más práctica es clasificar casos por nivel de riesgo y por tipo de dato, y luego asignar controles proporcionales. Así mantienes velocidad sin abrir la puerta a fugas o decisiones opacas.

Ejemplo: “resumir una reunión interna” (bajo riesgo) no es lo mismo que “decidir rechazos de candidatos” (alto impacto) o “responder reclamos legales” (alto riesgo).

Pasos para tu matriz de casos de uso (rápida y defendible)

- Crea 3 niveles: Permitido / Restringido / Prohibido.

- Define “alto impacto”: decisiones sobre personas, crédito, salud, empleo.

- Define “datos prohibidos” para herramientas no aprobadas (PII/PHI/secretos).

- Exige revisión humana en casos restringidos (human-in-the-loop).

- Pide evidencia: fuentes, citas internas, o “no confirmado” si no hay base.

- Define dónde se publica: borrador vs producción vs comunicación externa.

- Documenta ejemplos por área (ventas, soporte, ops, HR).

Tabla comparativa (enfoque de clasificación)

Enfoque Ventaja Riesgo Recomendación “Todo permitido” Adopción rápida Fugas, caos Evitar “Todo prohibido” Menos incidentes Shadow AI Evitar Por riesgo + datos Control proporcional Requiere gobernanza Ganador En resumen: Clasificar por riesgo y datos permite innovar con límites claros y controles proporcionales, sin bloquear a los equipos.

[Agenda diagnóstico gratis →]

¿Qué reglas de seguridad, privacidad y compliance no pueden faltar en normas de uso de IA en empresas?

Las normas mínimas deben cubrir: datos sensibles, propiedad intelectual, retención, proveedores, y trazabilidad. La política no reemplaza la ley, pero sí define cómo cumplirla operativamente.

La mayoría de incidentes no vienen de “hackers”, sino de uso cotidiano sin guía: prompts con datos de clientes, archivos internos compartidos, o respuestas inventadas (hallucinations) usadas como “verdad”.

Checklist de controles mínimos (según madurez)

- Clasificación de datos: qué se puede pegar/subir y qué no.

- Redacción y anonimización: reglas para PII/PHI antes de usar IA.

- Propiedad intelectual: qué contenido se puede reutilizar y cómo citar.

- Retención: cuánto se guarda, dónde, y quién accede (logs y prompts).

- Proveedores: evaluación de términos, training con tus datos, subprocesadores.

- Seguridad: SSO/MFA, control de acceso, segregación por áreas.

- Auditoría: registro de uso en casos críticos (quién, cuándo, para qué).

En resumen: Seguridad y compliance en IA es 80% disciplina operativa: datos, proveedores, retención y auditoría con reglas claras y aplicables.

[Solicita el checklist de despliegue seguro →]

¿Cómo se diseña la gobernanza de IA empresarial (roles, aprobaciones y auditoría) para 2026?

La gobernanza de IA empresarial define quién decide, quién aprueba, quién audita y quién responde ante incidentes. Sin roles, la política se incumple por falta de ownership, no por mala intención.

Ejemplo: un “agente” de soporte conectado al CRM responde 24/7. Si alucina políticas de devolución o expone datos, ¿quién es responsable: soporte, TI, legal, proveedor? La gobernanza lo resuelve antes del incidente.

Roles clave (mínimos) y qué hacen

- Sponsor ejecutivo: prioriza casos y presupuesto; desbloquea decisiones.

- Owner de negocio: define objetivos, SLAs y criterios de calidad.

- Owner de datos: autoriza fuentes, clasificación y acceso.

- Seguridad/Compliance: valida controles, privacidad, retención y auditoría.

- Operaciones/IT: despliega, integra, monitorea, gestiona cambios.

- Comité IA (ligero): aprueba casos restringidos y revisa incidentes.

En resumen: La gobernanza funciona cuando asigna responsabilidades reales (negocio + datos + seguridad + operación) y define aprobaciones/auditoría para casos de mayor riesgo.

¿Qué métricas deben exigirse para demostrar ROI y reducir riesgo en IA?

Las métricas deben medir valor (ingresos/ahorro) y control (calidad/riesgo). Si solo mides “uso”, premias el volumen, no el impacto.

Ejemplo: un agente SDR puede generar más leads, pero si baja la calidad o incumple mensajes legales, el costo reputacional supera el beneficio. Por eso se miden métricas “dobles”: performance + compliance.

KPIs recomendados (elige 5-7, no 30)

- Ahorro de tiempo por proceso (según medición interna).

- Tasa de resolución en primer contacto (soporte).

- Conversión por etapa (ventas/SDR).

- Calidad: score de revisión humana / QA.

- Tasa de escalamiento a humano (cuando aplica).

- Incidentes: severidad, tiempo de contención, recurrencia.

- Costo por resultado (tokens + herramientas + operación).

En resumen: ROI real requiere métricas de negocio y de control; medir solo “adopción” no prueba impacto ni reduce riesgo.

[Agenda diagnóstico gratis →]

¿Cómo implementar la política interna de IA sin que quede en un PDF olvidado?

Se implementa como un sistema: comunicación, formación, controles técnicos, y un ciclo de mejora. La política es el “qué”; el rollout es el “cómo”.

Si publicas la política en intranet, pero no hay herramientas aprobadas ni hard stops, la gente usará alternativas personales. La implementación evita el “shadow AI”.

Checklist de despliegue (implementación en 30-60 días, según tamaño)

- Publica herramientas aprobadas y alternativas oficiales.

- Entrena por rol: ventas, soporte, ops, HR (casos reales).

- Crea un canal de dudas/incidentes (Teams/Slack + formulario).

- Define un flujo de aprobación para casos restringidos.

- Configura controles: acceso, plantillas de prompts, logging.

- Lanza “quick wins” medibles por área para ganar adopción.

- Programa revisión: trimestral o al cambiar proveedor/regulación.

En resumen: La política vive si se acompaña con herramientas aprobadas, capacitación, flujos de aprobación y revisión continua.

¿Cuáles son los errores más comunes en una política interna de IA?

- Demasiado genérica: no define herramientas, datos ni ejemplos; nadie sabe cómo cumplirla.

- Prohibición total: empuja a shadow AI con cuentas personales y cero auditoría.

- Sin clasificación de datos: termina permitiendo PII/PHI en prompts “por accidente”.

- Sin roles ni aprobaciones: los casos críticos se lanzan sin dueño ni responsable.

- Sin entrenamiento: la gente no entiende límites, sesgos, ni cómo validar respuestas.

- Sin proceso de incidentes: se improvisa cuando ya hay daño o exposición.

- Sin revisión periódica: queda desactualizada frente a nuevos modelos y regulación.

En resumen: Los errores vienen de falta de operatividad: sin alcance, datos, roles y revisión, la política no se ejecuta.

¿Qué señales tempranas indican problemas en la gobernanza de IA empresarial?

- Herramientas “sombra”: equipos pagan apps con tarjeta personal o usan extensiones no aprobadas.

- Prompts con datos sensibles: aparecen nombres, teléfonos, historiales o contratos en chats.

- Respuestas sin fuente: decisiones basadas en texto “convincente” pero no verificable.

- Incidentes repetidos: mismos errores cada mes; no hay aprendizaje ni acción correctiva.

- Falta de ownership: nadie sabe quién aprueba casos restringidos o quién audita.

- Desalineación con marca/legal: mensajes inconsistentes o promesas no autorizadas en marketing/ventas.

- Métricas vacías: se reporta “uso” pero no impacto ni reducción de riesgo.

En resumen: Si ves shadow AI, datos sensibles en prompts y decisiones sin fuente, tu gobernanza está fallando antes de que explote un incidente.

¿Qué reglas de bloqueo (hard stops) se deben aplicar en normas de uso de IA en empresas?

- Si el prompt incluye PII/PHI o secretos comerciales → se bloquea y se solicita anonimización/redacción.

- Si la herramienta no está aprobada por TI/Seguridad → no se permite uso con datos internos.

- Si el caso es “alto impacto” (empleo, salud, crédito, legal) → requiere revisión humana + aprobación formal.

- Si el modelo/agente no tiene logging mínimo → no puede ir a producción.

- Si el proveedor no acepta términos de privacidad/retención requeridos → se descarta o se limita a datos públicos.

En resumen: Los hard stops evitan el 80% de incidentes típicos: bloquean datos sensibles, herramientas no aprobadas y casos de alto impacto sin control.

Caso típico: de pilotos aislados a adopción a escala (sin perder control)

Escenario: una empresa con equipos de ventas, soporte y HR empieza a usar IA en paralelo: un chatbot para FAQs, un agente para agendar citas, y generación de contenido para marketing. La dirección pide “escalar” porque ve potencial de productividad, pero no hay política uso IA.

Riesgos: datos de clientes en prompts, respuestas inventadas en soporte, mensajes de marca inconsistentes, y decisiones de HR sin trazabilidad. Además, cada área compra herramientas distintas y no se puede medir ROI de forma comparable.

Cómo lo resuelve el flujo:

- Se define una política interna de IA con alcance, clasificación de datos y matriz de casos.

- Se crea una gobernanza ligera: owners por área + owner de datos + seguridad/compliance.

- Se implementan hard stops y un proceso de excepciones para no frenar al negocio.

- Se despliegan casos prioritarios con medición: antes/después y QA humano.

- Se revisa trimestralmente: herramientas, incidentes, métricas y actualización por regulación.

Cómo trabajamos (metodología): diagnóstico rápido de procesos y datos, priorización por ROI/riesgo, borrador de política y roadmap por fases, y acompañamiento de implementación con agentes de IA autónomos y automatización (RAG, integraciones, omnicanal), según el contexto.

¿Cómo ayuda Smart CAIO a implementar una política uso IA sin frenar el crecimiento?

Para SMBs y enterprises con procesos para automatización en ventas, soporte, operaciones y HR, una política uso IA se vuelve útil cuando se aterriza en flujos reales, agentes y métricas. Smart Chief AI Officer (Smart CAIO) lo aborda desde ejecución: diagnóstico, borrador y roadmap, y luego implementación por fases.

- Dolor: “Cada equipo usa IA distinta y nadie controla datos” → Capacidad: centralizar herramientas aprobadas y definir flujos con clasificación de datos y accesos → Resultado: menos shadow AI y mayor trazabilidad.

- Dolor: “Soporte 24/7 responde cosas incorrectas” → Capacidad: desplegar agentes con base de conocimiento (RAG) y QA según riesgo → Resultado: respuestas más consistentes y auditables.

- Dolor: “No podemos probar ROI” → Capacidad: instrumentar métricas por proceso (ventas/soporte/ops) y reportes mensuales de impacto → Resultado: decisiones de inversión basadas en datos.

- Dolor: “Integraciones lentas con CRM/Calendar/ERP” → Capacidad: conectar agentes y automatizaciones con sistemas existentes (HubSpot/Salesforce/Calendar/ERP) → Resultado: menos trabajo manual y menor error operativo.

- Dolor: “El sitio web pierde clientes por performance” → Capacidad: crear un Smart Website no-code, modular y optimizado (Core Web Vitals) + IA para captación → Resultado: mejor conversión y velocidad (objetivos como <1.5s dependen de stack y contenido).

Objeciones típicas:

- "Ya tengo políticas de TI" → TI cubre infraestructura; IA requiere reglas de datos, casos de uso, auditoría y decisiones de alto impacto.

- "Somos chicos" → Aplica desde que hay 2-3 áreas usando IA o datos de clientes; ahí nacen los riesgos y el shadow AI.

- "No quiero cambiar todo" → Fase 1: política + hard stops + herramientas aprobadas; Fase 2: agentes/RAG por área; Fase 3: integraciones y métricas avanzadas.

- "Me preocupa el compliance" → Se diseña con clasificación de datos, retención, proveedores y revisión legal; no se asume un marco único para todos.

Lead Magnet:

Descarga la “Plantilla de política uso IA (alcance + matriz de casos + hard stops)” → (solicítala en el diagnóstico gratis)

CTA: Agendar diagnóstico gratis. En 30 min salís con: (1) evaluación de riesgo/ROI por proceso, (2) borrador inicial de política interna de IA, (3) roadmap de implementación por fases con Smart CAIO.

Glosario rápido

Política uso IA: documento operativo que define reglas, alcance, responsabilidades y controles para usar IA de forma segura y medible en la empresa.

Política interna de IA: versión adaptada a procesos y datos internos, con casos de uso, roles, aprobaciones y sanciones/medidas disciplinarias si aplica.

Gobernanza de IA empresarial: estructura de roles, decisiones, auditoría y gestión de incidentes para controlar IA en producción y en uso cotidiano.

LLM (Large Language Model): modelo que genera y entiende texto; puede resumir, redactar y razonar, pero puede inventar información si no se controla.

RAG (Retrieval-Augmented Generation): técnica para que la IA responda usando fuentes internas recuperadas, reduciendo alucinaciones y mejorando trazabilidad.

PII: datos personales identificables (nombre, teléfono, email); requieren controles de privacidad y minimización antes de usarse con IA.

PHI: datos de salud; suelen tener requisitos regulatorios más estrictos y deben tratarse como alto riesgo.

Human-in-the-loop: revisión humana obligatoria antes de publicar/decidir en casos restringidos o de alto impacto.

Shadow AI: uso de herramientas de IA no aprobadas por la empresa, generalmente sin auditoría, controles de datos ni términos adecuados.

Logging/Auditoría: registro de uso (quién, qué, cuándo, para qué) para investigar incidentes y demostrar cumplimiento, según riesgo y regulación aplicable.

Preguntas frecuentes (FAQ)

¿Qué debe incluir una política interna de IA para empresas?

Debe incluir alcance (herramientas/datos), matriz de casos permitidos/restringidos/prohibidos, reglas de seguridad y privacidad, y gobernanza (roles, aprobaciones, auditoría e incidentes). También un plan de implementación y revisión periódica.

¿Cuáles son los roles clave en la gobernanza de IA empresarial para 2026?

Sponsor ejecutivo, owner de negocio, owner de datos, seguridad/compliance, operaciones/IT y un comité ligero para aprobar casos restringidos. Lo importante es que cada rol tenga decisiones y responsabilidades explícitas.

¿Cómo implementar normas de uso de IA en empresas ante adopción masiva en México?

Empieza por clasificación de datos y herramientas aprobadas, luego matriz de casos por riesgo y hard stops. Acompaña con capacitación por área, flujo de excepciones y métricas de ROI/riesgo para sostener el cambio.

¿Qué herramientas de IA deben quedar cubiertas por la política?

LLMs, copilots, generadores de contenido, agentes autónomos, RAG, automatizaciones no-code/RPA y cualquier integración con CRM/ERP/soporte. También debe cubrir extensiones del navegador y cuentas personales si se usan para trabajo.

¿La política de IA reemplaza la política de seguridad de la información?

No. La complementa: seguridad cubre controles generales; la política de IA aterriza reglas específicas de prompts, datos, proveedores, auditoría, decisiones de alto impacto y publicación de resultados.

¿Qué debe incluir para mitigar riesgos éticos?

Clasificación de casos de alto impacto, revisión humana obligatoria, criterios de explicabilidad cuando aplique, registro/auditoría, y un proceso de incidentes. Además, reglas para evitar sesgos en HR y atención al cliente.

¿Cada cuánto se debe actualizar una política uso IA?

Típicamente trimestral o cuando cambien herramientas, proveedores, regulación o procesos críticos. La frecuencia real depende de madurez, industria y exposición al riesgo.

¿Cómo evitar que la política frene la innovación?

Usa un enfoque por riesgo: permite casos de bajo riesgo con guías simples y acelera aprobación en casos restringidos con un flujo claro. Prohibir todo suele generar shadow AI y más riesgo.

Conclusiones clave

- Una política uso IA convierte adopción dispersa en operación segura, trazable y medible.

- El alcance debe cubrir herramientas, datos, entornos y una matriz de casos por riesgo.

- Seguridad/compliance se aterriza con clasificación de datos, reglas de IP, retención, evaluación de proveedores y auditoría.

- La gobernanza de IA empresarial requiere roles con decisiones reales, aprobaciones y gestión de incidentes.

- Implementar exige checklist, hard stops y revisión periódica; el PDF solo no cambia comportamientos.

¿Listo para tener tu política uso IA en borrador y un roadmap accionable?

Agendar diagnóstico gratis con Smart Chief AI Officer. En 30 min salís con: (1) revisión de tu proceso actual y riesgos por área, (2) borrador de política interna de IA adaptado a tu negocio, (3) roadmap de implementación por fases con Smart CAIO (agentes, RAG, integraciones y métricas).