Riesgos de IA en empresas: principales riesgos y cómo mitigarlos

Respuesta rápida: Los riesgos de IA son fallas técnicas, legales y operativas que pueden exponer datos, degradar decisiones o afectar reputación al usar modelos y agentes.

- Datos y privacidad: fugas, uso indebido, acceso excesivo

- Seguridad: prompt injection, abuso de agentes, supply chain

- Calidad: sesgos, alucinaciones, errores de cumplimiento

Mitigarlos requiere gobernanza, controles y monitoreo continuo.

TL;DR

- Los riesgos de IA se concentran en datos, seguridad, cumplimiento y calidad de respuestas (sesgos/alucinaciones).

- “Shadow AI” y agentes sin controles elevan filtraciones, fraude y riesgo reputacional.

- La mitigación efectiva combina gobernanza (políticas + roles) y seguridad (controles técnicos + evaluación).

- RAG, control de herramientas (tooling) y pruebas continuas reducen alucinaciones y exposición de datos, según configuración.

- Un checklist antes/durante/después del despliegue evita que la IA llegue a producción “a ciegas”.

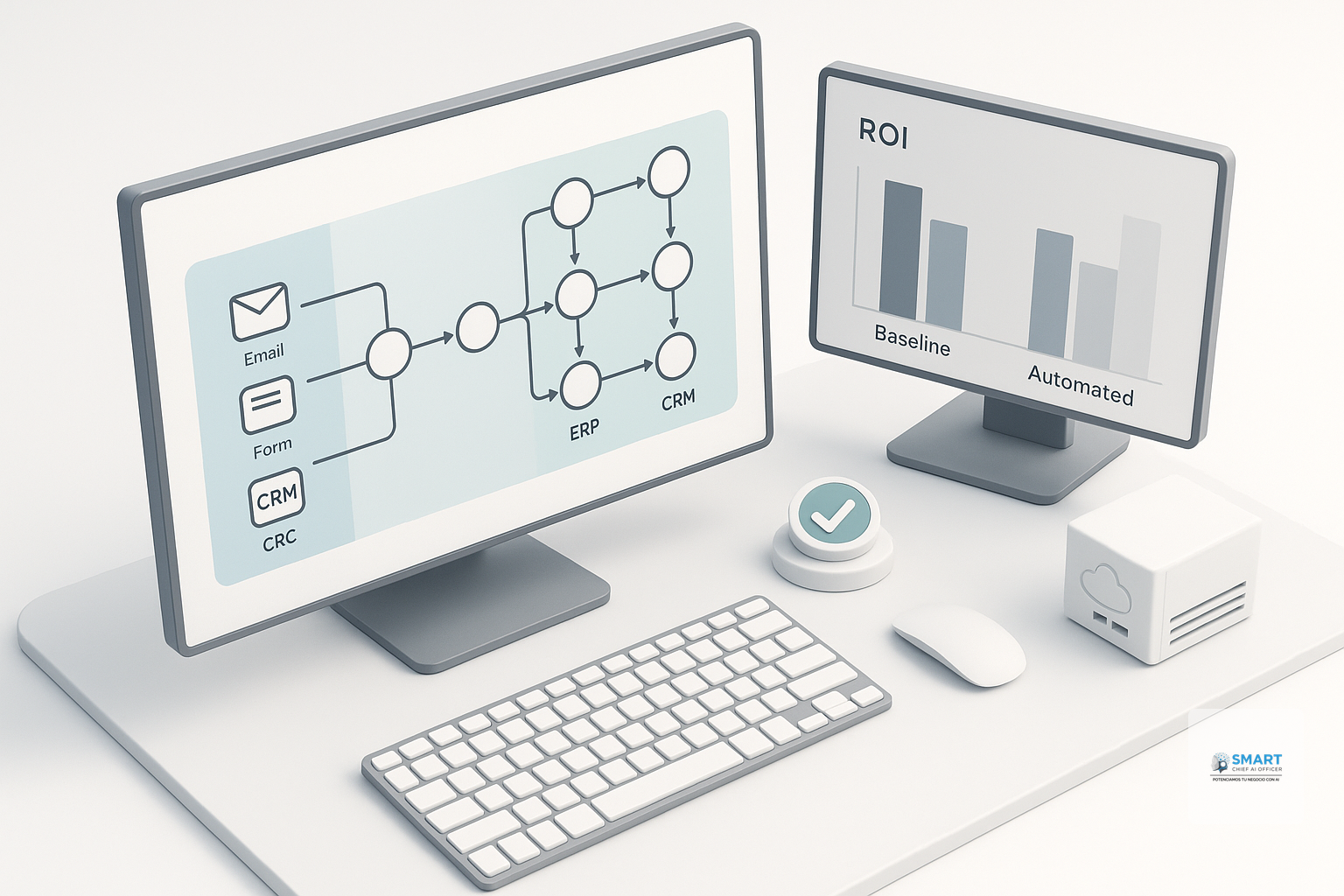

Implementar IA en una empresa ya no es solo “probar un chatbot”. Entre agentes de IA autónomos, integraciones con CRM/ERP y datos sensibles, el riesgo se mueve rápido: privacidad, ciberseguridad, cumplimiento y reputación.

En este artículo vas a ver qué significa “riesgo” en IA, cuáles son los principales riesgos de inteligencia artificial en empresas y cómo mitigar riesgos de IA con gobernanza y seguridad en IA, con checklist y reglas de bloqueo listas para aplicar.

¿Qué significa “riesgo” al implementar IA en una empresa?

Riesgo en IA es la probabilidad de que un sistema (modelo, agente o workflow) cause daño: filtración de datos, decisiones erróneas, incumplimientos o impactos reputacionales, por fallas técnicas o de proceso.

Checklist (mapa rápido de riesgos de IA):

- Definí caso de uso y “qué no puede hacer” la IA.

- Clasificá datos: público / interno / sensible / regulado.

- Determiná supervisión humana: cuándo es obligatoria.

- Evaluá superficie de ataque: prompts, herramientas, APIs, integraciones.

- Acordá criterios de calidad: precisión, trazabilidad, seguridad.

- Asigná owner (negocio) y owner (seguridad/compliance).

En resumen: Riesgo en IA no es solo “alucinaciones”; incluye datos, seguridad, cumplimiento y operación, y se gestiona con un mapa claro desde el día 1.

¿Cuáles son los principales riesgos de IA en empresas (y por qué crecen con agentes)?

Los principales riesgos de IA se agrupan en: datos y privacidad, sesgos, alucinaciones, ciberseguridad, cumplimiento y reputación; con agentes de IA, el riesgo sube porque la IA actúa (ejecuta herramientas) y no solo responde.

Además, “shadow AI” (uso de herramientas sin aprobación) multiplica exposición porque nadie sabe qué datos se enviaron a qué proveedor.

Pasos para priorizar riesgos (matriz simple):

- Listá sistemas que tocará la IA: CRM, correo, base de conocimiento, pagos, HRIS.

- Marcá dónde hay PII (datos personales) o secretos comerciales.

- Identificá acciones del agente: leer, escribir, enviar, comprar, borrar.

- Definí impacto: financiero, legal, operativo, reputacional.

- Priorizá por “impacto alto + probabilidad alta”.

- Convertí el top 5 en controles obligatorios antes de producción.

En resumen: Los riesgos de IA crecen con agentes porque pasan de “texto” a “acciones” sobre sistemas; por eso la priorización debe empezar por datos + herramientas + impacto.

[Agenda diagnóstico de 30 min →]

¿Qué riesgos de datos y privacidad aparecen al usar IA con información corporativa?

El riesgo principal es que datos sensibles salgan del perímetro (por prompts, logs, integraciones o proveedores) o queden accesibles por permisos mal definidos, generando filtraciones y exposición regulatoria.

Checklist de mitigación (datos y privacidad):

- Clasificá datos y aplicá minimización: la IA no necesita todo.

- Implementá DLP y redacción (masking) en inputs/outputs.

- Definí retención de logs y quién puede ver conversaciones.

- Asegurá cifrado en tránsito y en reposo, según tu stack.

- Exigí acuerdos con proveedores (DPA, subprocesadores, regiones).

- Aplicá RBAC/ABAC: permisos por rol y contexto, no “all access”.

En resumen: La IA amplifica el riesgo de datos porque mueve información por prompts, logs e integraciones; mitigarlo exige clasificación, minimización y controles de acceso/retención.

¿Cómo afectan los sesgos y la falta de explicabilidad a decisiones de negocio?

Los sesgos aparecen cuando datos, prompts o criterios de evaluación favorecen sistemáticamente a un grupo o resultado, y la falta de explicabilidad impide auditar por qué la IA recomendó algo, elevando riesgo legal y reputacional.

Ejemplo: un agente de IA para soporte puede priorizar tickets “más fáciles” si su objetivo es cerrar rápido, dejando sin atención casos complejos. No es “maldad”: es un objetivo mal definido y una evaluación incompleta.

Pasos para mitigar sesgos (práctico):

- Definí políticas de decisión: qué puede recomendar vs. decidir.

- Establecé datasets de evaluación representativos (casos edge).

- Medí desempeño por segmento (canal, región, tipo de cliente).

- Documentá prompts, versiones y cambios (control de configuración).

- Agregá “rationale” y trazabilidad: fuentes + por qué.

- Activá revisión humana en decisiones sensibles (HR, crédito, salud).

En resumen: Sesgo + poca explicabilidad se convierten en riesgo de negocio; se reduce con objetivos claros, evaluación por segmentos y trazabilidad de decisiones.

¿Qué son las alucinaciones y cómo se reducen sin “matar” la productividad?

Las alucinaciones son respuestas plausibles pero falsas; en empresas el problema no es el error aislado, sino que se convierta en ticket cerrado, venta perdida o mala decisión operativa.

Ejemplo: un bot de ventas inventa políticas de devolución o plazos de entrega. Aunque “suene bien”, te expone a reclamos y reputación.

Checklist para reducir alucinaciones (sin frenar el uso):

- Usá RAG con fuentes aprobadas (base de conocimiento versionada).

- Limitá el modelo a citar fuentes y decir “no sé” si falta evidencia.

- Definí guardrails: formatos, tono, límites de promesa comercial.

- Implementá evaluación automática (tests) antes de publicar cambios.

- Monitoreá “drift” de calidad: temas con más errores por semana.

- Separá entornos: sandbox → staging → producción.

En resumen: No se “eliminan” alucinaciones; se gestionan con RAG, guardrails y evaluación continua para mantener velocidad con control.

[Agenda diagnóstico de 30 min →]

¿Cuáles son los riesgos de ciberseguridad específicos de IA (prompt injection, data poisoning y agentes)?

Los riesgos de ciberseguridad en IA incluyen prompt injection (manipular instrucciones), data poisoning (contaminar datos) y abuso de agentes (que ejecuten acciones indebidas), además de riesgos de supply chain (modelos, plugins, librerías).

Pasos de mitigación (seguridad aplicada a IA):

- Tratá prompts como input no confiable: sanitización y reglas.

- Aislá herramientas del agente: allowlist y permisos mínimos.

- Usá scopes cortos para tokens y rotación automática.

- Implementá RAG con control de fuentes (no “web abierta” por defecto).

- Hacé red teaming / pruebas de ataque (prompt injection, jailbreaks).

- Registrá y alertá acciones: quién, qué, cuándo, con qué evidencia.

En resumen: IA introduce vectores nuevos (prompt injection, tool abuse); mitigarlos requiere seguridad “de app” + control de herramientas + pruebas ofensivas continuas.

¿Cómo se implementa gobernanza y seguridad en IA sin frenar al negocio?

Se implementa con un modelo operativo liviano: políticas claras, roles, controles técnicos mínimos y un ciclo de evaluación/monitoreo que permita iterar rápido sin pasar riesgos a producción.

Pasos (gobernanza mínima viable en 30-60 días, según madurez):

- Definí política de uso (datos permitidos, herramientas, excepciones).

- Armá un AI Steering: negocio + seguridad + legal + IT.

- Creá un registro de casos de uso (owner, datos, riesgos, controles).

- Establecé gates: qué se prueba, qué se aprueba, qué se audita.

- Implementá monitoreo: calidad, seguridad, costos, cumplimiento.

- Entrená equipos: “qué sí / qué no” y canal de excepciones.

En resumen: Gobernanza no es burocracia; es un sistema de decisiones y controles mínimos para escalar IA con velocidad y responsabilidad.

¿Qué checklist de implementación segura conviene usar antes, durante y después del despliegue?

Un checklist por fases evita el error típico: lanzar IA a producción sin controles, sin métricas y sin owner. Esto es especialmente crítico en agentes de IA autónomos conectados a CRM, WhatsApp, email o sistemas internos.

Ejemplo: un agente de soporte que puede “crear notas” en CRM sin validación puede insertar datos incorrectos, disparar workflows o exponer PII en campos visibles.

Checklist por fases (antes / durante / después):

- Antes: caso de uso + datos permitidos + owner + evaluación base.

- Antes: RAG con fuentes aprobadas + control de acceso a documentos.

- Durante: guardrails + allowlist de herramientas + registros/auditoría.

- Durante: pruebas OWASP LLM (inyección, exfiltración, jailbreak).

- Después: monitoreo de calidad + alertas + revisión periódica.

- Después: plan de incidentes (rollback, comunicación, evidencia).

Tabla comparativa (Excel/“pruebas manuales” vs gobernanza operativa):

Enfoque Velocidad Control Auditoría Recomendación Pruebas ad-hoc Alta al inicio Bajo Débil No para producción Checklist + gates Media Alto Fuerte Sí, escalable Sin gobernanza Muy alta Muy bajo Nula Evitar En resumen: El checklist por fases convierte “IA experimental” en “IA operable”, con gates, pruebas y monitoreo que sostienen el crecimiento.

[Descarga el checklist de implementación segura →]

¿Cuáles son los errores más comunes en riesgos de IA?

- “Shadow AI” tolerada: equipos usan herramientas sin control; luego nadie puede auditar datos, prompts ni proveedores.

- RAG sin gobierno de fuentes: se indexa cualquier documento; la IA responde con información desactualizada o sensible.

- Permisos excesivos al agente: tokens con acceso amplio; un fallo se vuelve incidente mayor.

- Sin evaluación continua: se testea una vez; cambios de datos/prompts degradan calidad sin que nadie lo note.

- Confundir “cumple” con “es seguro”: compliance sin controles técnicos deja puertas abiertas.

- No definir límites de decisión: el modelo decide donde solo debía recomendar.

En resumen: Los errores comunes vienen de falta de control operativo: datos, permisos, evaluación y límites claros de decisión.

¿Qué señales tempranas indican problemas en riesgos de IA?

- Aumento de “respuestas inventadas”: más reclamos por información falsa o contradictoria en soporte/ventas.

- Costos o uso anómalos: picos de tokens, llamadas a APIs o acciones del agente fuera de horario.

- Excepciones repetidas: el equipo pide “saltarse” controles para “salir rápido”.

- Datos sensibles en chats: aparecen PII/contratos en conversaciones o logs sin justificación.

- Drift de performance: cae la tasa de resolución o suben escalaciones humanas.

- Incidentes de identidad: tokens compartidos, llaves expuestas, cuentas de servicio sin rotación.

En resumen: Si ves drift, datos sensibles en chats o uso anómalo, tu IA ya está generando riesgo operativo; es momento de gates y monitoreo.

¿Qué reglas de bloqueo (hard stops) se deben aplicar en riesgos de IA?

- Si el prompt/input contiene PII o datos regulados → redacción automática + registro + aprobación para continuar.

- Si el agente intenta usar una herramienta fuera de allowlist → bloqueo y alerta a seguridad/IT.

- Si no hay fuente aprobada en RAG para una afirmación crítica → responder “no confirmado” y escalar a humano.

- Si el score de evaluación cae bajo el umbral definido → rollback a versión anterior + revisión de cambios.

- Si el proveedor/herramienta no tiene DPA y condiciones aceptadas → prohibido usar en datos internos.

En resumen: Los hard stops convierten la seguridad en un control automático, no en una recomendación que se ignora bajo presión.

Caso típico: agente de ventas y soporte omnicanal sin gobernanza

Escenario: empresa de servicios con marketing, ventas y soporte; atiende por WhatsApp, web y email; integra IA con CRM y una base de conocimiento que cambia semanalmente.

Riesgos: respuestas inventadas sobre precios/políticas, exposición de PII en chats, prompt injection desde mensajes externos, y acciones indebidas (crear/editar registros) por permisos amplios.

Cómo lo resuelve el flujo: separar “responder” de “actuar”. Primero, RAG con fuentes aprobadas y control de acceso; luego, herramientas del agente en allowlist con permisos mínimos; por último, evaluación continua con umbrales y rollback. Esto mantiene velocidad sin perder control.

Cómo trabajamos (Smart Chief AI Officer): arrancamos con diagnóstico de riesgos (datos, cumplimiento, seguridad), definimos gobernanza mínima viable, diseñamos el flujo del agente (RAG + herramientas + guardrails) y dejamos monitoreo con reportes de ROI y riesgo, según configuración y madurez del equipo.

Qué NO asumimos: no asumimos que tu marco regulatorio es igual en todos los países (protección de datos, retention, consentimiento, sector salud/finanzas). Tampoco reemplazamos asesoría legal; recomendamos revisión con tu equipo de compliance y seguridad.

¿Cómo ayuda Smart CAIO a reducir riesgos de IA en una empresa?

Smart CAIO (Smart Chief AI Officer) ayuda a reducir riesgos de IA con un enfoque práctico: diagnóstico, gobernanza mínima viable y despliegue de agentes con controles (RAG, permisos, auditoría y monitoreo).

- Dolor: “No sé qué datos usa la IA” → Capacidad: clasificación + minimización + DLP/masking → Resultado: menos exposición y mejor auditoría

- Dolor: “Agentes con permisos de más” → Capacidad: allowlist de herramientas + RBAC/ABAC + scopes cortos → Resultado: tool abuse controlado

- Dolor: “Respuestas inventadas en ventas/soporte” → Capacidad: RAG con fuentes aprobadas + citación + umbrales de “no responder” → Resultado: menos alucinaciones y reclamos

- Dolor: “Shadow AI en equipos” → Capacidad: política de uso + registro de casos + gates → Resultado: trazabilidad y control de proveedores/datos

- Dolor: “No puedo medir riesgo/ROI” → Capacidad: monitoreo de calidad, seguridad y costos + reportes mensuales → Resultado: decisiones basadas en métricas

Lead Magnet:

Solicita el checklist de hard stops para IA empresarial → (datos, herramientas, RAG, evaluación y monitoreo)

En 30 min salís con: mapa de riesgos por caso de uso + hard stops recomendados + roadmap de mitigación por fases.

Glosario rápido

Agentes de IA autónomos: Sistemas que no solo responden; también ejecutan acciones mediante herramientas (APIs) siguiendo objetivos y reglas definidas.

RAG (Retrieval-Augmented Generation): Técnica que hace que el modelo responda usando documentos recuperados de fuentes aprobadas, reduciendo alucinaciones y mejorando trazabilidad.

Prompt injection: Ataque que inserta instrucciones maliciosas en el input para que el modelo ignore reglas y exfiltre datos o ejecute acciones indebidas.

Data poisoning: Manipulación de datos de entrenamiento o de la base RAG para inducir respuestas incorrectas, sesgadas o peligrosas.

Shadow AI: Uso no autorizado de herramientas de IA por equipos, sin controles de datos, seguridad, proveedores ni auditoría.

Guardrails: Restricciones técnicas y de contenido (formatos, políticas, límites) que reducen riesgos y comportamientos no deseados del modelo.

RBAC/ABAC: Modelos de control de acceso por rol (RBAC) o por atributos/contexto (ABAC) para limitar quién puede ver o hacer qué.

DLP (Data Loss Prevention): Controles para detectar, bloquear o enmascarar datos sensibles en tránsito, uso o almacenamiento.

Red teaming: Pruebas ofensivas para encontrar vulnerabilidades (jailbreaks, exfiltración, tool abuse) antes de producción.

Drift: Degradación del desempeño del sistema por cambios en datos, contexto, comportamiento de usuarios o actualizaciones del modelo/prompts.

Preguntas frecuentes (FAQ)

¿Cuáles son los riesgos de IA agéntica en ciberseguridad empresarial?

Los agentes elevan el riesgo porque tienen “manos”: pueden llamar APIs, modificar datos o enviar mensajes. Sin allowlists, permisos mínimos y auditoría, un prompt malicioso puede convertirse en acción real.

¿Qué es shadow AI y por qué es tan peligroso?

Shadow AI es cuando equipos usan IA sin aprobación ni controles. Es peligroso porque expone datos sensibles, rompe cumplimiento y deja a la empresa sin trazabilidad ni capacidad de respuesta ante incidentes.

¿Cómo mitigar riesgos de prompt injection en herramientas de IA empresariales?

Tratando prompts como input no confiable: sanitización, políticas estrictas, separación de instrucciones del sistema, allowlist de herramientas y pruebas de jailbreak/prompt injection en staging.

¿La gobernanza de IA frena la innovación?

No si es mínima viable: define roles, reglas y gates para ir rápido con control. La alternativa (sin gobernanza) suele frenar más por incidentes, retrabajo y bloqueos tardíos.

¿RAG elimina las alucinaciones?

No las elimina por completo, pero típicamente las reduce si se configura bien: fuentes aprobadas, control de acceso, citación y umbrales para “no responder” cuando falta evidencia.

¿Qué riesgos reputacionales trae la IA generativa?

Respuestas falsas, promesas comerciales incorrectas, filtraciones y deepfakes pueden afectar marca y confianza. Se mitigan con guardrails, revisión humana en casos críticos y monitoreo continuo.

¿Qué debo monitorear en producción para una IA segura?

Calidad (precisión, escalaciones), seguridad (tool abuse, intentos de exfiltración), datos (PII en logs), costos/uso y cumplimiento (retención, accesos, proveedores).

Conclusiones clave

- Los riesgos de IA combinan datos, seguridad, cumplimiento y calidad; con agentes, el riesgo aumenta por capacidad de acción.

- La mitigación efectiva une gobernanza (roles/políticas) y controles técnicos (RAG, guardrails, allowlists, auditoría).

- Shadow AI es un multiplicador de riesgo porque elimina trazabilidad y control de datos/proveedores.

- Hard stops (si/entonces) evitan que incidentes se conviertan en daños reales, especialmente en integraciones con sistemas críticos.

- Checklist por fases + evaluación continua es la base para escalar IA con ROI medible, según configuración y madurez.

¿Listo para evaluar tus riesgos de IA y mitigarlos en 7 días?

Agendá tu diagnóstico gratis con Smart CAIO: evaluamos tus riesgos de IA (datos, cumplimiento y seguridad) y te entregamos un plan de mitigación en 7 días.

En 30 min salís con: tablero de riesgos por caso de uso + reglas de hard stops priorizadas + roadmap de implementación por fases.