Shadow AI: qué es y cómo controlarlo sin frenar la innovación

Respuesta rápida: Shadow AI es el uso de herramientas o modelos de IA por empleados sin aprobación, controles ni trazabilidad corporativa.

- Aumenta riesgo de fuga de datos y malware

- Rompe compliance y gobierno de información

- Dispara costos y baja calidad de decisiones

Con guardrails, catálogo y auditoría ligera, podés habilitar adopción segura sin apagar la innovación.

TL;DR

- Shadow AI ocurre cuando equipos usan IA sin aprobación, creando riesgos de seguridad, privacidad y compliance.

- Detectarlo requiere inventario, señales en TI/negocio y auditoría de datos/prompting (sin perseguir usuarios).

- La gobernanza efectiva es gradual: políticas claras + guardrails técnicos + aprobaciones livianas.

- Un plan 30-60-90 días permite pasar de “caos” a control medible con métricas de adopción, riesgo y ahorro.

- Smart Chief AI Officer (Smart CAIO) ayuda a implementar gobernanza y adopción segura, sin frenar productividad.

La IA generativa se metió en ventas, soporte, operaciones y HR más rápido que los procesos de TI. El resultado: Shadow AI (uso “por fuera”) que acelera tareas… pero también abre brechas.

En este artículo vas a ver qué es Shadow AI, por qué aparece, cuáles son los riesgos de Shadow AI y cómo detectar Shadow AI sin convertirlo en una cacería de brujas.

También te llevás un framework de gobernanza de IA empresarial (guardrails + capacitación + catálogo) y un plan 30-60-90 días para controlar el riesgo sin frenar la innovación.

¿Qué es Shadow AI y por qué ocurre en empresas?

Shadow AI es el uso de IA (apps, extensiones, modelos, agentes, APIs) sin aprobación formal, sin evaluación de riesgos y sin controles de datos. Ocurre porque la IA “resuelve” fricción diaria más rápido que los ciclos de compras, seguridad y legal.

Se suele reportar que una mayoría de empleados usa IA sin aprobación (a veces se cita “75%” en divulgación; validá el dato con el reporte original). Ese patrón explica por qué la prohibición total suele fallar.

Checklist: por qué aparece Shadow AI (y cómo reconocerlo)

- Equipos necesitan velocidad (respuestas, copy, análisis).

- Falta un “catálogo” corporativo de IA aprobada.

- Políticas confusas: “sí, pero no” (nadie sabe).

- Compras y security tardan más que el negocio.

- Incentivos: productividad individual > riesgo sistémico.

- Herramientas freemium con onboarding instantáneo.

En resumen: Shadow AI no es “mala intención”; es un síntoma de demanda real de productividad sin una vía segura y rápida.

¿Cuáles son los riesgos principales de Shadow AI (seguridad, privacidad, compliance, costos y datos)?

Los riesgos de Shadow AI se concentran en cinco frentes: ciberseguridad, privacidad, cumplimiento, costos y calidad de datos/decisiones. El problema no es “usar IA”, sino hacerlo sin controles: no sabés qué datos entran, dónde quedan, quién accede y qué sale.

Como referencia, suele citarse el costo promedio de una brecha (por ejemplo, cifras atribuidas a IBM en reportes anuales; verificá el año y el valor exacto en la fuente oficial). También aparecen amenazas asociadas a automatización/IA en notas de ciberseguridad; confirmá IOCs y detalles con fuentes de seguridad antes de tomar decisiones.

Checklist: riesgos de Shadow AI por categoría

- Seguridad: fuga de secretos, credenciales, código, PII; plugins/extensiones con permisos excesivos.

- Privacidad: envío de datos sensibles a terceros sin base legal o contrato (DPA).

- Compliance: incumplir políticas internas, requisitos sectoriales y regulaciones locales (validar aplicabilidad por país).

- Costos: suscripciones duplicadas, consumo de APIs sin control, “shadow spend”.

- Calidad de datos: alucinaciones, decisiones sin trazabilidad, datasets mezclados sin linaje.

En resumen: Shadow AI convierte productividad local en riesgo global: datos sin control + decisiones sin trazabilidad + costos invisibles.

[Agendar diagnóstico de 30 min →]

¿Cómo detectar Shadow AI sin perseguir a tu equipo?

Detectar Shadow AI es construir visibilidad: qué herramientas se usan, para qué procesos, con qué datos y con qué nivel de riesgo. El enfoque correcto es “observabilidad + alternativas seguras”, no vigilancia punitiva.

Ejemplo típico: marketing usa un generador de imágenes, soporte pega tickets en un chatbot público, HR resume CVs con una extensión del navegador. Cada caso parece inocuo hasta que aparece PII, datos clínicos, contratos o credenciales.

Checklist: cómo detectar Shadow AI (rápido y sin fricción)

- Armar un inventario de apps IA (SaaS, extensiones, APIs, agentes).

- Revisar gastos: tarjetas, reembolsos, facturas SaaS, consumo cloud.

- Analizar tráfico (CASB/SWG/Proxy) hacia dominios de IA (según stack).

- Entrevistas cortas por área: “top 5 tareas donde usás IA”.

- Muestreo de prompts/datos: qué se pega y qué se exporta (con consentimiento y reglas).

- Clasificar por riesgo: datos sensibles, acceso a sistemas, automatización (agentes).

En resumen: Detectar Shadow AI es mapear uso real + datos involucrados + superficie de ataque, y convertirlo en un backlog de control.

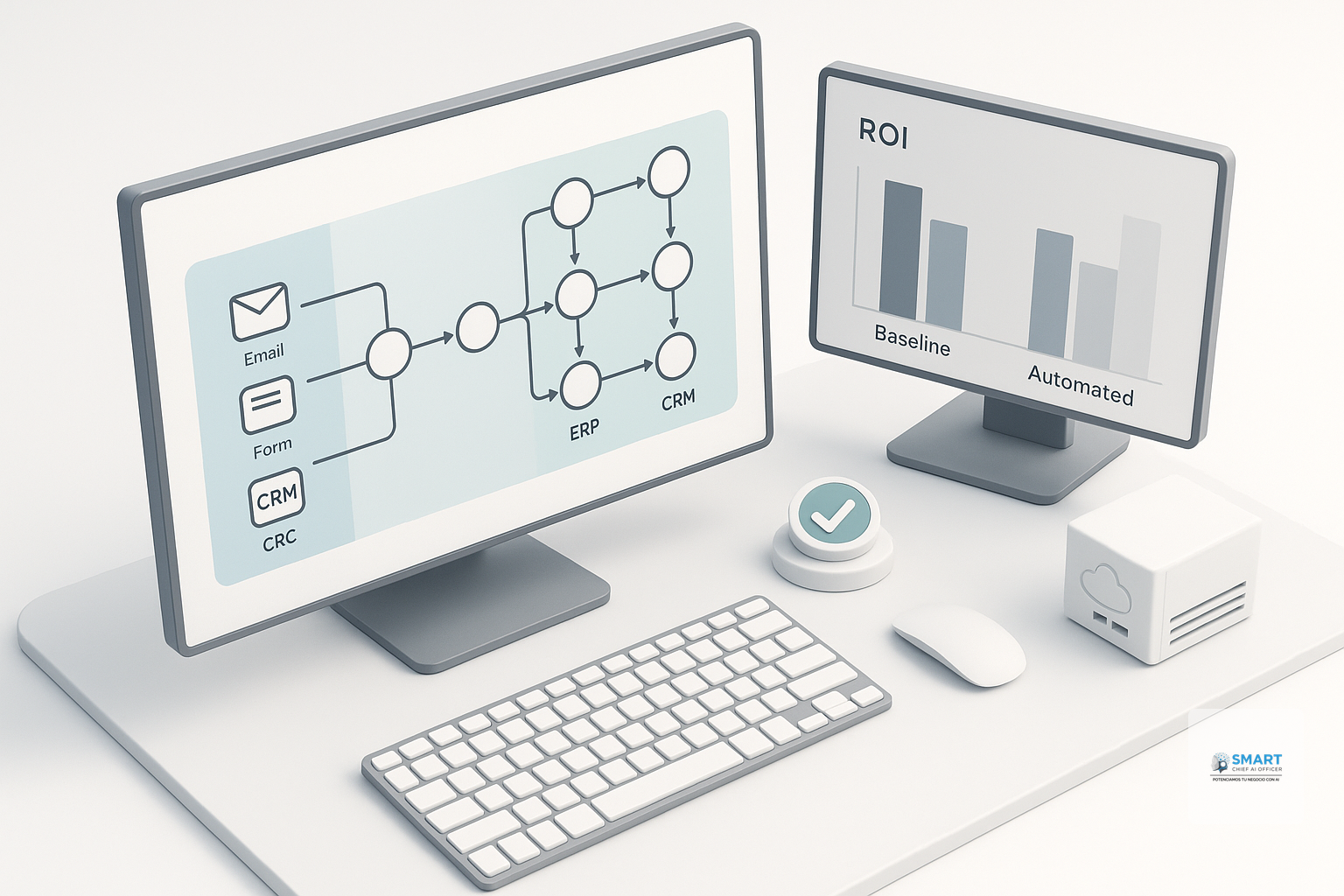

¿Qué modelo de gobernanza de IA empresarial controla Shadow AI sin frenar innovación?

La gobernanza que funciona es gradual: define límites claros (guardrails), habilita caminos rápidos (aprobaciones livianas) y crea un catálogo de herramientas seguras. En IA agéntica, además, hay que evitar el “agent washing” (llamar “agente” a algo que no tiene controles ni autonomía definida) y exigir criterios mínimos de seguridad y supervisión humana.

Cuando TI solo dice “no”, el negocio se va a herramientas públicas. Cuando TI ofrece un “sí, así” (catálogo + plantillas + RAG corporativo), el uso se mueve a canales controlados.

Checklist: framework práctico de gobernanza (mínimo viable)

- Política simple: qué datos no se comparten y por qué.

- Guardrails técnicos: SSO, DLP, logging, segregación por entornos.

- Aprobación liviana por riesgo (bajo/medio/alto), no por “nombre de herramienta”.

- Catálogo de IA aprobada con casos de uso (ventas, soporte, HR, ops).

- Capacitación por rol (prompting + datos + evaluación de outputs).

- Comité pequeño (security+legal+negocio) con SLAs de respuesta.

En resumen: Gobernanza no es burocracia: es un sistema de “sí seguro” con límites explícitos, observabilidad y rutas rápidas.

[Agendar diagnóstico de 30 min →]

¿Qué conviene más: prohibir IA, permitir libre o habilitar un “catálogo con guardrails”?

La recomendación práctica es “catálogo con guardrails”: mantiene velocidad y reduce riesgos. Prohibir suele empujar el uso a la sombra; permitir libre aumenta exposición y costos.

Tabla comparativa (resumen extractable):

Enfoque Velocidad Riesgo Trazabilidad Recomendación Prohibición total Baja Alto “en sombra” Muy baja Evitar Libre uso Alta Muy alto Baja Evitar Catálogo + guardrails Alta Medio-bajo Alta Ganador Checklist: criterios para decidir qué entra al catálogo

- Manejo de datos sensibles (sí/no, bajo qué controles).

- Contratos y DPA disponibles (legal/compliance).

- SSO/MFA y administración centralizada.

- Logging/auditoría exportable.

- Controles de retención y entrenamiento con datos.

- Integración segura (APIs, tokens, scopes).

En resumen: Entre velocidad y control no hay trade-off inevitable: el “catálogo con guardrails” suele ser el punto óptimo.

¿Qué controles mínimos (políticas + guardrails) reducen Shadow AI desde la semana 1?

El “mínimo viable” combina reglas claras de datos con controles técnicos básicos y una alternativa aprobada que sea igual de fácil de usar. Si no hay alternativa, la política se ignora.

Ejemplo: si soporte necesita responder 24/7, prohibir IA no elimina la necesidad. En cambio, habilitar un agente con base de conocimiento (RAG) y logging reduce riesgo y mejora consistencia.

Checklist: controles mínimos de alto impacto

- Clasificación de datos: público / interno / confidencial / regulado.

- Regla de oro: nunca pegar PII/PHI/contratos sin canal aprobado.

- SSO + roles: acceso por función, no por “quién lo pidió”.

- Logging de prompts/respuestas (con política de privacidad interna).

- Plantillas de prompt aprobadas por proceso (ventas/soporte/HR).

- Sandbox para experimentar sin datos reales.

En resumen: Semana 1 = reglas de datos + SSO/logging + una alternativa segura; eso reduce Shadow AI sin apagar productividad.

Lead Magnet:

Descarga la “Plantilla de inventario de Shadow AI + matriz de riesgo” → incluye campos mínimos por herramienta, datos usados, dueño, riesgo y plan de remediación.

¿Cómo implementar un plan 30-60-90 días para controlar Shadow AI y medir resultados?

Un plan 30-60-90 convierte el problema en ejecución: visibilidad, control y adopción segura medible. Las métricas deben cubrir adopción (uso), riesgo (exposición) y eficiencia/costo (ahorro), siempre según configuración y madurez de procesos.

Ejemplo de métricas realistas: % de herramientas inventariadas, % de flujos con logging, reducción de apps duplicadas, tiempos de aprobación por riesgo, tasa de uso del catálogo.

Checklist: plan 30-60-90 días (operativo)

- 0-30 días: inventario + clasificación de datos + políticas mínimas + quick wins.

- 31-60 días: catálogo v1 + guardrails (SSO/logging) + capacitación por roles.

- 61-90 días: auditoría continua + RAG corporativo + automatizaciones y reporting de riesgo/ROI.

- Definir owners por proceso (ventas, soporte, HR, ops).

- Establecer SLAs de aprobación (bajo riesgo en horas/días, no semanas).

- Medir y ajustar: lo que no se mide, vuelve a la sombra.

En resumen: 30-60-90 días te saca del “no sabemos” al “controlamos y habilitamos”, con métricas que el negocio entiende.

[Agendar diagnóstico de 30 min →]

¿Cuáles son los errores más comunes en la gestión de Shadow AI?

- Prohibir sin alternativa: empuja el uso a canales invisibles y aumenta el riesgo real.

- Tratarlo como “problema de TI”: sin negocio adentro, no hay adopción del catálogo.

- Políticas largas e inusables: nadie las lee; se necesita una versión “one-page”.

- No clasificar datos: sin reglas de datos, cualquier control es cosmético.

- Aprobar por herramienta, no por riesgo: genera burocracia y frena innovación útil.

- No registrar prompts/outputs: sin trazabilidad, no podés auditar ni mejorar.

En resumen: Los errores típicos son de diseño del sistema: mucha fricción, poca alternativa segura y cero trazabilidad.

¿Qué señales tempranas indican problemas en Shadow AI?

- Gasto SaaS “raro” o fragmentado: suscripciones pequeñas repetidas en varias áreas.

- Tickets de seguridad por extensiones: plugins con permisos excesivos o comportamiento anómalo.

- Outputs inconsistentes al cliente: respuestas diferentes para el mismo caso en soporte/ventas.

- Datos sensibles en canales no aprobados: PII en prompts, capturas o documentos compartidos.

- Automatizaciones sin owner: agentes “corriendo” sin responsable ni monitoreo.

- Resistencia a auditoría ligera: “no podemos mostrar cómo lo hacemos” suele indicar riesgo.

En resumen: Si aparecen costos invisibles, extensiones sospechosas y decisiones sin trazabilidad, Shadow AI ya está afectando seguridad y calidad.

¿Qué reglas de bloqueo (hard stops) se deben aplicar en Shadow AI?

- Si el prompt incluye PII/PHI/contratos → usar solo canal aprobado con logging y DLP; si no existe, se bloquea el envío.

- Si una herramienta no tiene SSO/MFA administrable → no se autoriza para datos internos; solo sandbox con datos públicos.

- Si un “agente” puede ejecutar acciones (email, CRM, pagos) → requiere supervisión humana, scopes mínimos y auditoría.

- Si no hay owner de negocio + owner técnico → la herramienta sale del catálogo hasta asignación.

- Si no hay registros exportables (logs) → no se permite en procesos críticos o regulados.

En resumen: Los hard stops deben proteger datos y acciones: sin identidad, logs y owners, no hay operación segura.

Caso típico: Shadow AI en soporte, ventas y HR “crece sin dueño”

Escenario: 3 áreas (ventas, soporte, HR) adoptan IA en paralelo; soporte usa chat público para respuestas, ventas usa extensiones para emails, HR resume CVs con una app freemium. Cada equipo “mejora” su productividad, pero nadie ve el sistema completo.

Riesgos: fuga de PII, decisiones sin trazabilidad (por qué se rechazó un candidato), inconsistencias en atención, costos duplicados y exposición a extensiones/malware. En organizaciones así, el problema no es la herramienta: es la falta de catálogo, datos clasificados y logging.

Cómo lo resuelve el flujo (sin frenar innovación):

- Inventario rápido + matriz de riesgo por proceso.

- Catálogo v1: 1-2 opciones aprobadas por área, con SSO y logging.

- RAG corporativo para soporte/ventas (respuestas desde conocimiento interno, no “internet”).

- Capacitación por rol + plantillas de prompts y evaluación de calidad.

- Auditoría ligera mensual: qué se usa, con qué datos, y qué se automatiza.

Cómo trabajamos (Smart Chief AI Officer / Smart CAIO): empezamos con un diagnóstico práctico (inventario + riesgos + brechas), definimos guardrails y un roadmap por fases, y luego implementamos con owners de negocio y TI para sostener adopción.

Qué NO asumimos: compliance, privacidad y obligaciones regulatorias varían por país e industria. Recomendamos revisión con legal/ciberseguridad interno antes de formalizar políticas y contratos.

¿Cómo ayuda Smart CAIO a controlar Shadow AI sin frenar la innovación?

Para SMBs y empresas con procesos para automatizar en ventas, soporte, operaciones y HR, Shadow AI suele ser el síntoma de una necesidad real: velocidad sin un camino seguro. Smart Chief AI Officer implementa esa gobernanza con Smart CAIO como capa operativa para estandarizar flujos, aprobaciones y trazabilidad en la adopción de IA (incluyendo agentes con RAG e integraciones).

- Dolor: “No sabemos qué IA se usa” → Capacidad: centralizar inventario, owners, aprobaciones y evidencias → Resultado: visibilidad accionable y auditoría simple.

- Dolor: “Se pegan datos sensibles en cualquier lado” → Capacidad: guardrails por tipo de dato y proceso con aprobaciones por riesgo → Resultado: menos exposición y control demostrable.

- Dolor: “Agentes sin supervisión” → Capacidad: flujos de revisión por roles y trazabilidad de cambios/acciones → Resultado: supervisión humana donde corresponde.

- Dolor: “Costos SaaS duplicados” → Capacidad: consolidar catálogo y controlar altas por proceso → Resultado: reducción de shadow spend (según madurez y ejecución).

- Dolor: “Resultados inconsistentes” → Capacidad: estandarizar plantillas, criterios de calidad y ciclos de mejora → Resultado: outputs más consistentes y medibles.

Objeciones típicas:

- "Ya tengo políticas de TI" → Política sin catálogo/guardrails y sin alternativa usable suele terminar en uso “en sombra”.

- "Mi empresa es chica" → Aplica desde que hay datos sensibles o 2+ áreas usando IA sin coordinación.

- "No quiero cambiar todo" → Fase 1: inventario + hard stops; Fase 2: catálogo + guardrails; Fase 3: agentes con RAG + auditoría continua.

- "No tenemos tiempo" → El enfoque 30-60-90 prioriza quick wins y reduce riesgo sin frenar operaciones.

Lead Magnet:

Solicita el “Checklist de hard stops + campos mínimos de auditoría de Shadow AI” → para implementar controles desde la primera semana.

CTA (diagnóstico gratis): Agendá tu diagnóstico con Smart Chief AI Officer (Smart CAIO).

En 30 min salís con: mapa de Shadow AI (inventario + riesgos) + brechas de compliance/prioridades + plan 30-60-90 de control y adopción segura sin frenar innovación.

Glosario rápido

Shadow AI: uso de herramientas/modelos de IA sin aprobación, controles de seguridad, ni trazabilidad corporativa.

Gobernanza de IA empresarial: políticas, roles, procesos y controles técnicos para usar IA de forma segura, legal y medible.

Guardrails: límites técnicos y operativos (SSO, DLP, logging, scopes) que reducen riesgos sin bloquear productividad.

DLP (Data Loss Prevention): controles para prevenir fuga de datos sensibles por canales no autorizados.

SSO/MFA: autenticación centralizada y multifactor para controlar acceso y reducir cuentas “huérfanas”.

RAG (Retrieval-Augmented Generation): técnica para responder con IA usando conocimiento interno recuperado, reduciendo alucinaciones y mejorando trazabilidad.

Agent washing: llamar “agente” a automatizaciones sin controles, sin supervisión humana o sin definición clara de autonomía y riesgos.

Trazabilidad (logging): registro auditable de prompts, respuestas, fuentes y acciones para control, mejora y cumplimiento.

PII/PHI: datos personales/datos de salud; suelen requerir mayores controles legales y de seguridad.

Catálogo de IA: lista curada de herramientas y casos de uso aprobados, con reglas de datos, owners y SLAs de aprobación.

Preguntas frecuentes (FAQ)

¿Qué es Shadow AI y por qué es un riesgo interno tan grande en 2026?

Shadow AI es IA usada sin aprobación ni controles, lo que crea puntos ciegos de datos, costos y seguridad. En 2026 el riesgo crece porque la IA se integra a tareas críticas y agentes pueden ejecutar acciones, no solo “chatear”.

¿Cuáles son los riesgos de Shadow AI en ciberseguridad empresarial?

Incluye fuga de datos, extensiones maliciosas, exposición de credenciales y automatizaciones sin supervisión. El mayor problema es la falta de trazabilidad: no podés auditar qué se envió ni qué se decidió.

¿Cómo detectar Shadow AI en equipos que usan IA sin autorización?

Combiná inventario por entrevistas cortas, revisión de gastos SaaS, análisis de tráfico a dominios de IA (según tu stack) y muestreo de datos/prompting. El objetivo es visibilidad y alternativas seguras, no sanción.

¿Cómo controlo Shadow AI sin frenar la innovación?

Implementá un catálogo con guardrails: reglas simples de datos, SSO/logging, aprobaciones livianas por riesgo y capacitación por rol. Si el “camino seguro” es más fácil que el inseguro, la adopción se mueve sola.

¿Qué políticas mínimas debería tener una empresa para IA generativa?

Una política “one-page” con clasificación de datos, qué está prohibido compartir, qué herramientas están aprobadas y cómo pedir excepciones. Sumá responsabilidades (owners) y requisitos de logging para procesos críticos.

¿Qué métricas sirven para medir gobernanza y adopción segura de IA?

% herramientas inventariadas, % flujos con logging, tiempo de aprobación por riesgo, reducción de apps duplicadas y calidad de outputs (por muestreo). Los ahorros dependen de configuración y madurez de procesos.

¿Cómo afecta la regulación (por ejemplo Chile) a Shadow AI?

Los marcos regulatorios suelen exigir supervisión humana, gestión de riesgos y evidencia de controles, especialmente en usos de alto impacto. Validá siempre con legal local porque el alcance y obligaciones varían por país e industria.

Conclusiones clave

- Shadow AI es uso de IA sin aprobación ni controles, y suele aparecer por necesidad real de velocidad.

- Los riesgos principales se concentran en seguridad, privacidad, compliance, costos y calidad de datos/decisiones.

- Detectar Shadow AI requiere inventario + señales en TI/negocio + auditoría ligera de datos y prompting.

- La gobernanza efectiva es gradual: catálogo de IA aprobada con guardrails y aprobaciones livianas por riesgo.

- Un plan 30-60-90 días convierte el problema en control medible sin frenar la innovación.

Diagnóstico gratis: controlá tu Shadow AI sin perder velocidad

Si tu equipo ya usa IA “por fuera”, el riesgo no se resuelve con un memo. Se resuelve con visibilidad, guardrails y un catálogo que el negocio realmente quiera usar.

Agendá diagnóstico gratis con Smart Chief AI Officer (Smart CAIO). En 30 min salís con:

- inventario y mapa de riesgos de Shadow AI,

- brechas de compliance/prioridades por proceso,

- plan 30-60-90 de control y adopción segura de IA sin frenar innovación.