Gobernanza de IA para implementar IA segura, privada y trazable desde el día uno

Respuesta rápida: La gobernanza de IA es el conjunto de políticas, roles y controles que aseguran que tu IA sea segura, privada y auditable desde el primer piloto.

- Define quién puede hacer qué (roles y permisos)

- Controla datos permitidos y privacidad en IA

- Registra trazabilidad de IA con logging y auditoría

El resultado: puedes escalar IA empresarial con menos riesgo y menos deuda técnica.

(Total: 54 words. Self-contained and extractable. Citation-ready for Google AI Overviews, Perplexity, and ChatGPT.)

TL;DR

- La gobernanza de IA empieza antes del primer prompt: políticas, permisos, datos permitidos y auditoría mínima.

- Privacidad en IA se logra con minimización, control de acceso y reglas de uso de datos, no solo con “no subir PII”.

- Trazabilidad de IA exige logs por decisión/acción, versiones de prompts, fuentes (RAG) y aprobaciones.

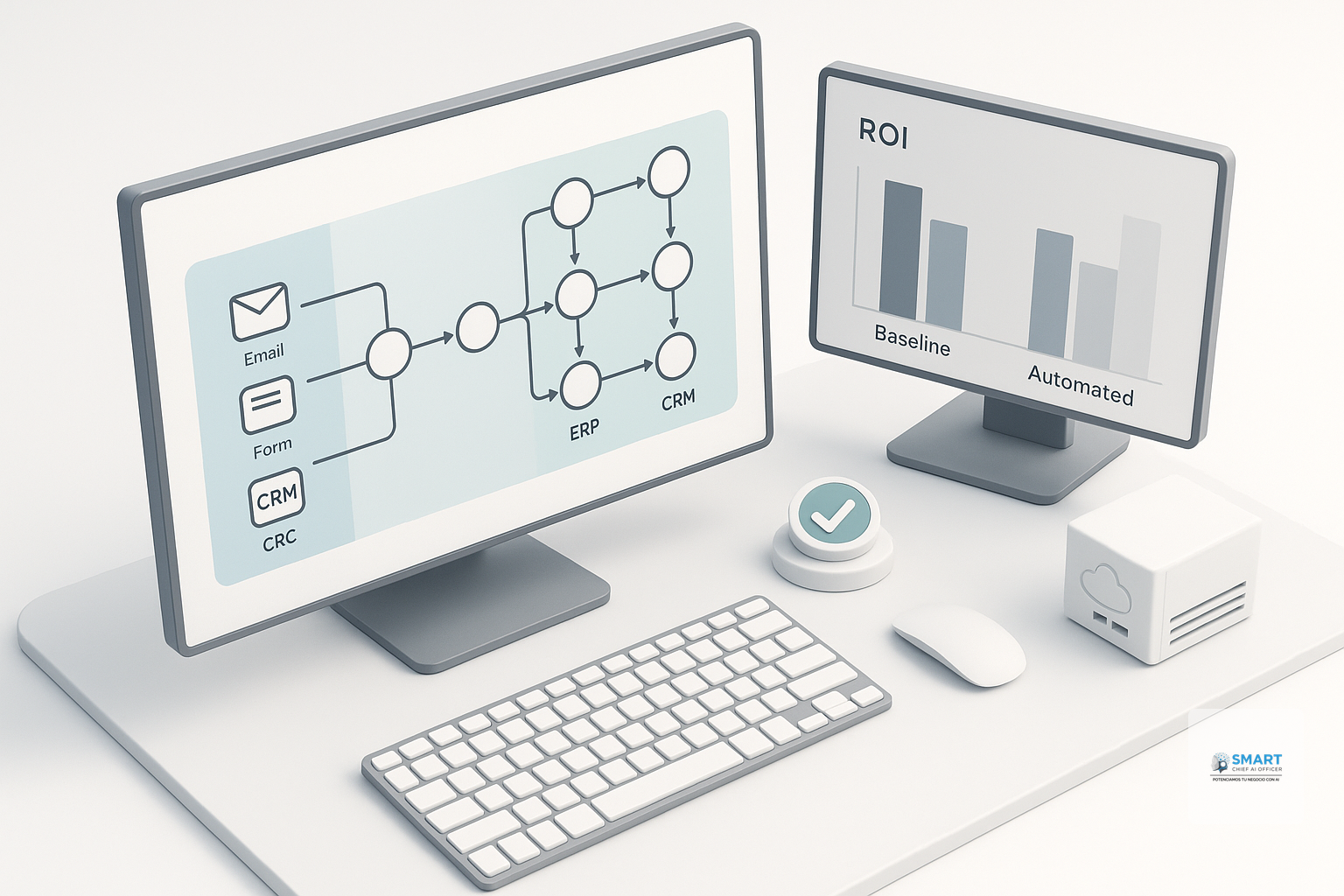

- La arquitectura práctica combina RAG, RBAC/ABAC, logging centralizado y evaluación continua para IA empresarial.

- Un diagnóstico rápido puede revelar brechas críticas y entregar un roadmap de implementación por fases en 7 días.

Implementar IA hoy ya no es “probar un chatbot”. Con agentes autónomos (agentic AI) y sistemas multimodales ganando terreno, el riesgo sube: más acciones, más datos, más superficies de ataque y más exigencia de auditoría.

La buena noticia: no necesitas burocracia para tener control. Necesitas una gobernanza mínima viable desde el día uno: decisiones claras, datos permitidos definidos, permisos por acción, trazabilidad y métricas.

En este artículo te llevas un checklist de arranque, una arquitectura práctica (RAG + control de acceso + logging) y un proceso paso a paso para pilotos, validación, despliegue y monitoreo continuo.

¿Qué significa “implementar IA empresarial con gobernanza” en la práctica?

Implementar IA empresarial con gobernanza significa que cada modelo, prompt, dato y acción tiene dueño, reglas, permisos y evidencia auditable de qué pasó, cuándo y por qué.

Ejemplo/Prueba: en equipos de ventas y soporte, el salto de “copiloto que sugiere” a “agente que ejecuta” (crear tickets, modificar CRM, agendar citas) exige supervisión, responsabilidad y control por acción; ese énfasis aparece de forma consistente en marcos de gobernanza ética y transparencia promovidos por actores como IBM (verifica su guía vigente para tu industria).

Checklist práctico (día uno, sin burocracia):

- Definir casos de uso permitidos (y prohibidos) por área: ventas, soporte, HR, operaciones.

- Asignar roles de gobernanza: dueño de proceso, dueño de datos, security, compliance, negocio.

- Establecer política de datos permitidos: PII/PHI, financieros, credenciales, secretos, NDA.

- Diseñar permisos por acción (no solo por usuario): leer, escribir, aprobar, ejecutar.

- Exigir trazabilidad mínima: logs de prompts, fuentes RAG, respuestas, acciones y aprobaciones.

- Definir criterios de salida de piloto: calidad, riesgo, privacidad, adopción, ROI esperado.

En resumen: Gobernanza de IA es control operativo (roles, datos, permisos y auditoría) aplicado desde el primer piloto para escalar sin sorpresas.

¿Qué políticas, roles y riesgos hay que definir el primer día para privacidad en IA y trazabilidad de IA?

El primer día debes definir “quién responde” y “qué está permitido”: roles, política de datos, matriz de riesgos y trazabilidad mínima. Sin eso, la IA se vuelve un shadow IT con riesgo reputacional y operativo.

Ejemplo/Prueba: un agente de soporte con acceso a base de conocimiento puede filtrar información sensible si no hay clasificación de datos y reglas de redacción (redaction) antes de responder; el problema no es el modelo, es la falta de política y control.

Checklist “día uno” (políticas + roles + riesgos + datos):

- Política de uso de IA: usos permitidos, prohibidos, y canales autorizados.

- Clasificación de datos: público, interno, confidencial, regulado (según tu país/industria).

- Roles mínimos: Product Owner IA, Data Owner, Security Owner, Auditor/Compliance, Operaciones.

- Matriz de riesgos: privacidad, seguridad, sesgo, alucinación, ejecución indebida, vendor risk.

- Datos permitidos por caso de uso: qué campos sí/no pueden entrar a prompts o RAG.

- Reglas de retención de logs: cuánto tiempo, quién accede, cómo se anonimiza.

En resumen: Privacidad en IA y trazabilidad de IA se resuelven con roles claros, política de datos permitidos y evidencia auditable desde el inicio.

[Agendar diagnóstico gratis →]

¿Qué arquitectura práctica permite RAG con control de acceso, logging y auditoría sin frenar al negocio?

Una arquitectura práctica para IA empresarial combina RAG (para respuestas con fuentes), control de acceso (RBAC/ABAC) y logging/auditoría centralizada para reconstruir decisiones y acciones.

Ejemplo/Prueba: en operaciones, un agente que consulta procedimientos internos (RAG) y luego abre un ticket en tu ITSM necesita (1) leer solo documentos permitidos por rol, (2) registrar qué fuentes usó, y (3) dejar evidencia de la acción en el sistema de registro.

Pasos de arquitectura (mínimo viable, escalable):

- Implementar RAG con fuentes gobernadas (repositorios aprobados, no “cualquier PDF”).

- Aplicar RBAC/ABAC: permisos por rol y por atributo (área, región, sensibilidad).

- Usar logging centralizado: prompt, contexto, fuentes, respuesta, acción, usuario, timestamp.

- Incorporar auditoría por evento: aprobaciones, excepciones, accesos a datos sensibles.

- Definir entornos (dev/piloto/prod) con llaves y secretos separados.

- Ejecutar evaluación continua: calidad, seguridad, privacidad, drift y fallos.

Tabla comparativa (para decidir rápido):

Enfoque Privacidad Trazabilidad Escalabilidad Recomendación “Chatbot suelto” Baja Baja Baja Evitar en empresa RAG + RBAC Media/Alta Media Alta Buen punto de partida RAG + RBAC + auditoría Alta Alta Alta Ganador En resumen: RAG sin control de acceso y sin logs es una demo; RAG + permisos + auditoría es implementación de IA empresarial.

[Agendar diagnóstico gratis →]

¿Cómo asegurar trazabilidad total en arquitecturas RAG y sistemas multiagente desde el día uno?

Aseguras trazabilidad de IA cuando puedes reconstruir una respuesta o acción: qué entrada tuvo, qué fuentes consultó, qué versión de prompt/modelo se usó y quién aprobó.

Ejemplo/Prueba: si un agente “actualiza una oportunidad en CRM”, la auditoría debe mostrar: intención, datos de entrada, herramienta usada, cambios efectuados y confirmación humana (si aplica). En sistemas multiagente, además necesitas rastrear “agente A delegó a agente B” y sus permisos.

Checklist de trazabilidad (mínimo auditable):

- ID de conversación y sesión por usuario/canal (web, WhatsApp, email).

- Registro de fuentes RAG (documento, sección, timestamp, score).

- Versionado de prompts y políticas (cambios y aprobaciones).

- Registro de acciones (API calls): qué se hizo y resultado.

- Motivo de decisión (policy reason): por qué se permitió/bloqueó.

- Trail de aprobaciones (human-in-the-loop) para acciones sensibles.

En resumen: “Trazabilidad total” no es guardar chats: es auditar fuentes, versiones, acciones y aprobaciones con un hilo reconstruible.

¿Cómo implementar IA empresarial paso a paso sin deuda técnica (pilotos → validación → despliegue → monitoreo)?

La implementación de IA empresarial sin deuda técnica se logra con fases: piloto acotado, validación con métricas, despliegue con controles y monitoreo continuo con ownership claro.

Ejemplo/Prueba: en clínicas/servicios, empezar con un agente de turnos (bajo riesgo) permite validar RAG, permisos y logs antes de pasar a un agente que toca facturación o historia clínica (alto riesgo).

Proceso por fases (operativo, repetible):

- Seleccionar 1 caso de uso con impacto y riesgo controlado.

- Definir datos permitidos + fuentes RAG y limpiar “knowledge base”.

- Implementar guardrails: permisos por acción, redacción, límites.

- Medir calidad y riesgo antes de producción (evaluaciones y tests).

- Desplegar con aprobaciones para acciones críticas (HITL).

- Monitorear con tablero: incidentes, drift, adopción, costos.

En resumen: La mejor implementación de IA empresarial es por fases, con controles desde el piloto y monitoreo continuo para escalar sin deuda técnica.

Lead Magnet (descargable):

Descarga la “Plantilla día uno de gobernanza de IA” (políticas + roles + datos permitidos + logging mínimo) →

¿Qué métricas y documentación mínima necesitas para cumplir, auditar y escalar IA?

Necesitas métricas que midan calidad, riesgo, privacidad y operación; y documentación mínima que permita auditoría sin frenar al equipo.

Ejemplo/Prueba: dos equipos pueden tener la misma “precisión percibida”, pero uno genera incidentes por accesos indebidos; por eso, además de calidad, se miden eventos de seguridad, excepciones y trazabilidad.

Métricas clave (elige 5–7 por caso de uso):

- Tasa de escalamiento a humano (por intención y canal).

- Incidentes de privacidad (detecciones PII/PHI en prompts/respuestas).

- Cobertura de fuentes RAG (respuestas con cita vs sin evidencia).

- Tasa de acciones bloqueadas (por política/permisos).

- Tiempo de resolución (soporte) o tiempo de ciclo (operaciones).

- Costo por conversación/acción (según proveedor y configuración).

Documentación mínima viable (para auditar y operar):

- Ficha del caso de uso (objetivo, alcance, riesgos, owner).

- Política de datos permitidos (inputs, outputs, retención).

- Matriz de permisos por acción (quién puede ejecutar qué).

- Plan de monitoreo (métricas, alertas, responsables, SLAs internos).

- Registro de cambios (prompts, fuentes, modelos, integraciones).

En resumen: Si no puedes medir incidentes, bloqueos y evidencia RAG, no puedes auditar ni escalar IA con confianza.

¿Cuáles son los errores más comunes en gobernanza de IA?

- “Primero probemos y después gobernamos”: el piloto crea hábitos y datos; luego es caro corregir trazabilidad y permisos.

- “Privacidad = no subir PII”: ignorar clasificación y minimización deja fugas por contexto, logs o integraciones.

- RAG sin fuentes gobernadas: respuestas “con documentos” pero sin control de acceso ni citación verificable.

- Sin permisos por acción: agentes que pueden ejecutar cambios críticos sin aprobación ni límites.

- Logs incompletos o inútiles: guardar texto sin IDs, versiones, fuentes y acciones impide auditoría real.

- Métricas solo de calidad: no medir riesgo, incidentes y bloqueos oculta fallas operativas.

En resumen: Los errores comunes vienen de confundir “demo” con “sistema”: sin datos permitidos, permisos y logs, no hay gobernanza.

¿Qué señales tempranas indican problemas en gobernanza de IA?

- Respuestas sin fuentes RAG: el equipo no puede verificar, y aumenta el riesgo de alucinación en decisiones.

- Accesos “temporales” que quedan fijos: permisos excepcionales se vuelven permanentes sin revisión.

- Aumento de prompts con datos sensibles: señales de política de datos permitidos inexistente o incumplida.

- Cambios de prompt sin control: variaciones no aprobadas generan resultados inconsistentes y difíciles de auditar.

- Incidentes repetidos “menores”: pequeñas fugas o errores operativos anticipan un incidente mayor.

- Dependencia de una persona: si solo “Juan sabe cómo funciona”, no hay gobernanza ni continuidad.

En resumen: Si faltan fuentes, control de cambios y señales de privacidad, la IA está creciendo sin barandas.

¿Qué reglas de bloqueo (hard stops) se deben aplicar en gobernanza de IA?

- Si el input contiene datos sensibles no permitidos → se redacta/anonimiza o se bloquea y se deriva a humano.

- Si no hay fuente RAG permitida para una respuesta “factual” → el sistema responde con “no sé” + solicita contexto.

- Si una acción impacta sistemas críticos (CRM/ERP/pagos) → requiere aprobación humana (HITL) y registro de motivo.

- Si el usuario/rol no tiene permiso explícito para una herramienta → el agente no puede ejecutar esa acción.

- Si el modelo/prompt cambió sin aprobación → no se despliega a producción hasta pasar evaluación y firma.

En resumen: Los hard stops convierten políticas en ejecución: bloquean, derivan y dejan evidencia cuando hay riesgo.

Caso típico: de “copiloto” a agentes autónomos sin perder control

Escenario: una empresa con equipos de ventas, soporte y operaciones quiere automatizar lead intake, seguimiento, FAQs y creación de tickets. Usa CRM (HubSpot/Salesforce), calendar, email y un repositorio de SOPs. Planea sumar agentes que ejecuten tareas 24/7 en web y WhatsApp.

Riesgos:

- Privacidad en IA: fuga de PII en prompts, respuestas o logs; acceso indebido a SOPs internos.

- Trazabilidad de IA: no poder explicar por qué se respondió algo o se ejecutó una acción.

- Operación: agentes que crean datos basura en CRM o disparan flujos erróneos.

Cómo lo resuelve el flujo (patrón típico):

- Empezar con RAG acotado (solo knowledge base aprobada) y canales controlados.

- Definir datos permitidos por intención (turnos, soporte, ventas) y redactar lo sensible.

- Aplicar permisos por acción: leer vs escribir vs ejecutar; y HITL para cambios críticos.

- Centralizar logging + auditoría con IDs, fuentes, versiones y acciones.

- Pasar a multiagente solo cuando hay monitoreo y ownership (alertas + responsables).

Cómo trabajamos (Smart Chief AI Officer / Smart CAIO):

- Diagnóstico rápido de gobernanza (políticas, datos, permisos, trazabilidad) y priorización por riesgo/ROI.

- Diseño de flujo y controles (RAG, accesos, logging, evaluación) + piloto medible.

- Roadmap por fases para industrializar (más casos de uso, más canales, más integraciones) sin deuda técnica.

Qué NO asumimos (importante):

- No asumimos un marco legal único: privacidad, retención y auditoría varían por país e industria; se valida con legal/compliance.

- No asumimos que “tu CRM es la fuente de verdad” sin revisar calidad de datos y permisos reales.

- No asumimos que un KPI sirve para todos: métricas dependen del caso de uso y madurez operativa.

¿Cómo ayuda Smart Chief AI Officer (Smart CAIO) a gobernanza de IA con privacidad y trazabilidad desde el día uno?

Para SMBs y enterprises con procesos para automatizar en ventas, soporte, operaciones y HR—y presión por escalar sin contratar—Smart Chief AI Officer con Smart CAIO ayuda a pasar de pruebas sueltas a IA operable, con control, evidencia y métricas.

- Dolor: “No sé qué respondió la IA ni con qué datos” → Capacidad: registrar conversaciones, fuentes, versiones y decisiones con auditoría → Resultado: trazabilidad de IA para auditorías e incidentes.

- Dolor: “Se filtra información sensible” → Capacidad: definir datos permitidos, redactar/anonimizar y aplicar políticas por intención → Resultado: menos incidentes de privacidad en IA (según configuración y cumplimiento).

- Dolor: “Agentes ejecutan acciones indebidas” → Capacidad: permisos por acción + aprobaciones humanas para acciones críticas → Resultado: reducción de ejecuciones no autorizadas y control operativo.

- Dolor: “Pilotos que no escalan” → Capacidad: proceso por fases con métricas, evaluación y monitoreo continuo → Resultado: implementación de IA empresarial repetible, sin deuda técnica.

- Dolor: “No hay ROI medible” → Capacidad: tablero de KPIs operativos y reportes periódicos → Resultado: decisiones basadas en evidencia (impacto depende de caso de uso y adopción).

Objeciones típicas:

- "Ya tengo herramientas de IA" → Tener herramientas no es tener gobernanza: faltan datos permitidos, permisos por acción y auditoría end-to-end.

- "Mi negocio es chico" → Aplica desde que hay 2+ áreas, 2+ canales o integraciones (CRM + WhatsApp/email) y riesgo de datos sensibles.

- "No quiero cambiar todo" → Fase 1: políticas + RAG acotado + logging; Fase 2: integraciones y permisos por acción; Fase 3: multiagente + monitoreo avanzado.

- "Me preocupa compliance" → Se diseña con mínimos auditables y revisión legal; no prometemos cumplimiento sin validación por tu asesoría.

Lead Magnet:

Solicita el “Checklist de hard stops para IA empresarial” (privacidad, permisos, auditoría) →

CTA (diagnóstico gratis):

En 30 min salís con:

(1) score de gobernanza/privacidad/trazabilidad,

(2) lista de brechas priorizadas por riesgo/ROI,

(3) roadmap de implementación en 7 días por fases.

Agendar diagnóstico gratis con Smart CAIO →

Glosario rápido

Gobernanza de IA: conjunto de políticas, roles y controles para operar IA con seguridad, privacidad, calidad y auditoría en producción.

Privacidad en IA: prácticas para minimizar, proteger y controlar datos personales/sensibles usados por modelos, prompts, logs e integraciones.

Trazabilidad de IA: capacidad de reconstruir entradas, fuentes, versiones, decisiones y acciones de un sistema de IA con evidencia auditable.

RAG (Retrieval-Augmented Generation): técnica que hace que la IA responda usando documentos recuperados, ideal para conocimiento interno con citación.

RBAC: control de acceso basado en roles; define permisos según el rol del usuario (ventas, soporte, admin).

ABAC: control de acceso basado en atributos; permite reglas por región, sensibilidad del dato o tipo de cliente.

Human-in-the-loop (HITL): aprobaciones humanas obligatorias antes de ejecutar acciones críticas o de alto riesgo.

Logging: registro estructurado de prompts, contexto, fuentes, respuestas, acciones y resultados para monitoreo y auditoría.

Guardrails: reglas técnicas y operativas que limitan comportamientos de la IA (datos permitidos, acciones, tono, seguridad).

Drift: cambio gradual del rendimiento por variación de datos, contexto o comportamiento de usuarios; requiere monitoreo continuo.

Preguntas frecuentes (FAQ)

¿Qué es gobernanza de IA y por qué importa para agentes autónomos?

La gobernanza de IA define reglas, permisos y auditoría para que la IA no sea una “caja negra” operativa. En agentes autónomos es crítica porque pasan de responder a ejecutar acciones en sistemas.

¿Cómo se implementa privacidad en IA sin frenar a los equipos?

Con política de datos permitidos, minimización, redacción/anonimización y control de acceso por rol/atributo. Además, se monitorea y se bloquea automáticamente cuando entra información sensible no autorizada.

¿Qué logs mínimos necesito para trazabilidad de IA?

IDs de sesión, prompts/contexto, fuentes RAG citadas, versiones de prompt/modelo, acciones (API calls) y aprobaciones. Sin eso, no puedes auditar ni investigar incidentes.

¿Cómo asegurar trazabilidad en RAG si uso muchas fuentes internas?

Gobernando repositorios (fuentes aprobadas), aplicando control de acceso por documento y registrando qué fragmentos se recuperaron. También debes versionar fuentes y políticas para reproducibilidad.

¿Qué métricas clave sirven para auditar privacidad y trazabilidad?

Incidentes de PII/PHI, tasa de respuestas sin fuente, acciones bloqueadas por política, escalamiento a humano y registro completo por evento. Las métricas exactas dependen del caso de uso y tu madurez.

¿Cuánto tarda pasar de piloto a producción con gobernanza mínima viable?

Depende del alcance, integraciones y nivel de riesgo; típicamente se logra un piloto gobernado primero y se escala por fases. Lo importante es no saltar a producción sin permisos por acción y auditoría.

¿Necesito compliance/legal desde el día uno?

Sí, al menos para validar clasificación de datos, retención de logs y riesgos por industria/país. La implementación técnica no reemplaza la revisión legal; la complementa.

Conclusiones clave

- Gobernanza de IA es control operativo: roles, datos permitidos, permisos por acción y auditoría desde el primer piloto.

- Privacidad en IA se diseña con minimización, control de acceso y hard stops, no con “buena voluntad” del usuario.

- Trazabilidad de IA requiere logs estructurados: fuentes RAG, versiones, acciones y aprobaciones.

- La implementación de IA empresarial debe ser por fases: piloto acotado → validación → despliegue → monitoreo continuo.

- Un checklist día uno + arquitectura práctica (RAG + RBAC/ABAC + logging) reduce riesgo y deuda técnica al escalar.

Implementa gobernanza de IA con un roadmap en 7 días (diagnóstico gratis)

Si estás por lanzar copilotos o agentes autónomos en ventas, soporte, operaciones o HR, no esperes a “tener un incidente” para ordenar gobernanza, privacidad y trazabilidad.

Agendar diagnóstico gratis con Smart CAIO.

En 30 min salís con:

(1) tablero de nivel de gobernanza,

(2) reglas y hard stops recomendados,

(3) roadmap de implementación en 7 días por fases.